Meilleurs outils d'extraction de données en 2026, plus intelligents, plus rapides, automatisés

Andrea Lopez

Partager

Les outils d’extraction de données en 2026 sont devenus essentiels pour les entreprises qui dépendent d’informations précises et en temps réel pour stimuler leur croissance. Dans un monde où les données alimentent tout, de la génération de leads à l’analyse concurrentielle et aux prévisions des tendances du marché, ces outils permettent de collecter, nettoyer et structurer automatiquement les données du web à grande échelle.

Le défi pour la plupart des entreprises n’est plus l’accès aux données, mais la manière de les extraire efficacement, sans perdre de temps ni risquer des problèmes de conformité.

Les outils modernes d’extraction de données résolvent ce problème en combinant l’IA, l’automatisation et des interfaces no-code, transformant le contenu web non structuré en insights exploitables prêts à être utilisés dans les CRM, les tableaux de bord ou les plateformes d’analyse.

Dans ce guide, nous expliquerons ce que signifie réellement l’extraction de données en 2026, pourquoi elle est devenue une capacité stratégique pour les équipes B2B et enterprise, et quels outils ouvrent la voie en matière de rapidité, de scalabilité et d’automatisation intelligente.

Comprendre l’extraction de données

Qu’est-ce que l’extraction de données ?

L’extraction de données est le processus consistant à récupérer des informations à partir de sources diverses afin d’obtenir des insights et de prendre des décisions commerciales éclairées. Ces informations peuvent être structurées, non structurées ou partiellement structurées, selon la source — une pratique essentielle pour les entreprises cotées en bourse et les organisations qui dépendent d’un accès rapide et conforme aux données commerciales.

Par exemple, dans la vente B2B, l’extraction de données peut consister à récupérer des informations sur des leads depuis les réseaux sociaux afin de créer une liste de prospects ciblée. Cependant, une automatisation excessive ou le scraping peuvent parfois déclencher des restrictions sur les réseaux sociaux, il est donc essentiel de comprendre les limites des plateformes avant de lancer une extraction de données à grande échelle.

L’extraction de données constitue la première étape du processus ETL (Extract, Transform & Load). Les outils ETL prennent des données brutes provenant de diverses sources et les préparent pour leur intégration dans un autre système, en veillant à ce qu’elles soient dans le bon format pour l’analyse. Un exemple d’outil fonctionnant de manière similaire à ETL est Captain Data, qui réalise des tâches telles que la collecte de données à partir de plusieurs sources web, l’agrégation de données brutes en informations structurées et leur intégration fluide dans votre CRM ou d’autres outils.

Pourquoi les entreprises ont besoin de l’extraction de données

Les entreprises s’appuient sur l’extraction de données pour plusieurs raisons :

Construire des bases de données d’informations pertinentes et à jour.

Générer des insights exploitables pour les stratégies de vente et de marketing.

Améliorer la qualité des données en se concentrant sur les sources pertinentes et en réduisant les erreurs humaines.

Obtenir une compréhension plus fine du marché et de la concurrence. C’est particulièrement vrai lorsqu’on la combine avec des signaux d’achat B2B, qui aident les équipes à comprendre l’intention au-delà des ensembles de données bruts — des insights qui révèlent souvent de nouvelles opportunités commerciales pour les équipes commerciales et marketing.

Comment fonctionne l’extraction de données

Alors que le moteur de recherche de Google offre un exemple d’extraction de données en explorant des sites web et en extrayant des informations pour les résultats de recherche, cet article se concentre principalement sur l’extraction de données structurées, souvent appelée « données intelligentes ». Les données structurées sont bien organisées et prêtes pour l’analyse. Les logiciels d’automatisation, comme Captain Data, utilisent des techniques de web scraping pour collecter ces données intelligentes.

Web scraping ou extraction de données web

Le web scraping consiste à extraire des données publiquement disponibles depuis des sites web, permettant l’agrégation rapide d’informations précieuses pour les intégrer dans une base de données. Parmi les types de données pouvant être extraites figurent les e-mails, les numéros de téléphone et les adresses postales. Le web scraping peut être classé en deux catégories : manuel et automatisé.

Le scraping manuel consiste à copier-coller manuellement des informations dans une base de données ou un tableur, ce qui convient aux tâches d’extraction de données à petite échelle.

Le scraping automatisé, en revanche, utilise des outils d’extraction de données qui récupèrent rapidement de grands volumes de données à partir de sources en ligne.

Le web scraping est particulièrement précieux pour les équipes commerciales, car il aide à :

Constituer des listes d’entreprises cibles et de leads à partir de sources comme Sales Navigator sur les réseaux sociaux, Google Maps, les Pages Jaunes, et bien plus encore.

Identifier les principaux décideurs et les opportunités commerciales potentielles.

Enrichir et scorer les leads.

Gagner du temps en automatisant la saisie manuelle des données tout en améliorant la précision grâce à des outils avancés d’enrichissement des données qui complètent les workflows d’extraction.

Présentation des outils d’extraction de données

Que font les outils d’extraction de données ?

Les outils d’extraction de données utilisent l’automatisation pour extraire des données à partir de formulaires, de sites web, d’e-mails et d’autres sources en ligne.Les outils d’extraction de données utilisent l’automatisation pour extraire des données à partir de formulaires, de sites web, d’e-mails et d’autres sources en ligne, servant souvent de base à l’enrichissement des données CRM et à la qualification des leads.

Ces outils se répartissent en plusieurs catégories :

Solutions SaaS

Extensions Chrome

Bots de scraping / API de web scraping

Bibliothèques open source

Proxies et jeux de données

Les avantages des logiciels d’extraction de données

Les logiciels d’extraction de données offrent de nombreux avantages, notamment :

Gain de temps : l’automatisation réduit l’effort manuel nécessaire aux processus liés aux données.

Plus grande efficacité : accomplir davantage en moins de temps.

Facilité d’utilisation : les outils d’extraction de données no-code simplifient la mise en place de workflows d’automatisation des données, même pour les utilisateurs non techniques.

Précision : réduire au minimum le risque d’erreur humaine.

Scalabilité : accéder rapidement à de grands volumes de données structurées pour soutenir la croissance de l’entreprise, comme la génération de leads et les opportunités commerciales.

Entrons maintenant dans le top 10 des outils d’extraction de données.

Les 10 meilleurs outils d’extraction de données pour 2026

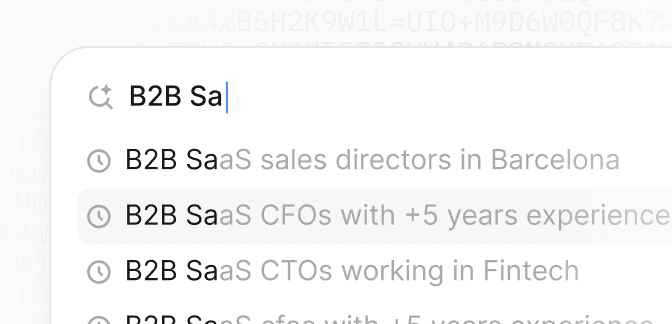

1. Enginy

Enginy se distingue comme la plateforme ultime de génération de leads B2B et d’automatisation de l’outreach par IA, conçue pour tout le monde, des responsables commerciaux aux utilisateurs non techniques. Cet outil convivial simplifie la génération de leads en intégrant l’agrégation de données B2B à l’automatisation de la prospection. Avec Enginy, créer des listes de leads à partir des réseaux sociaux, enrichir les données avec des e-mails et numéros de téléphone vérifiés, et lancer des campagnes d’outreach automatisées via e-mail et réseaux sociaux devient un jeu d’enfant. Enginy met l’accent sur la simplicité d’utilisation et la standardisation, ce qui le rend accessible à tous, des Sales Managers aux recruteurs, en offrant des résultats de manière simple et efficace.

2. Phantom Buster

Phantom Buster est un puissant outil d’automatisation de tâches en ligne conçu pour simplifier et accélérer les processus répétitifs sur le web. Il offre un large éventail de capacités d’automatisation, notamment le web scraping pour l’extraction de données, l’automatisation des réseaux sociaux, les interactions à grande échelle, l’automatisation de tâches liées à la vente, des actions personnalisables, des intégrations et une grande flexibilité grâce à divers modèles et configurations. Phantom Buster rationalise et accélère les tâches en ligne, faisant gagner du temps aux utilisateurs et améliorant l’efficacité des opérations en ligne.

3. Captain Data

Captain Data décroche la troisième place, offrant une multitude de scénarios d’extraction de données et d’automatisation. Il facilite l’extraction de données structurées à partir de plus de 30 sources, dont les réseaux sociaux, Google et TrustPilot. Au-delà d’un simple outil de web scraping, Captain Data est une suite complète d’automatisation des données, avec plus de 400 workflows prêts à l’emploi. Il permet aux équipes commerciales et marketing de travailler plus efficacement, sans avoir besoin de coder. Captain Data est une solution idéale pour les équipes Sales Ops et Growth qui cherchent à faire évoluer la génération de leads et à accélérer la croissance de l’entreprise.

4. Octoparse

Octoparse est un service d’extraction de données polyvalent, adapté à la génération de leads, à la surveillance des prix, au marketing et à la recherche. Il se distingue par sa facilité d’utilisation, permettant d’extraire des données avec une approche point-and-click, sans compétences en codage requises. Le crawler web basé sur le cloud d’Octoparse peut extraire des données de divers sites web et générer des tableaux de données structurées. Les utilisateurs peuvent planifier et automatiser des tâches 24/7 à l’aide de workflows en glisser-déposer. Octoparse récupère du texte, des liens, des URL d’images et bien plus encore sur l’ensemble du web. Il propose une offre gratuite avec jusqu’à 10 crawlers, et l’offre standard démarre à 75 $/mois.

5. Diffbot

Diffbot s’adresse aux entreprises qui ont des besoins spécifiques en matière de crawling et de screen scraping de données. Il propose une suite de fonctionnalités permettant de convertir des données web non structurées en bases de données structurées et contextuelles. Diffbot excelle dans l’extraction d’articles, de pages d’actualité, de pages produits et de forums. Les utilisateurs apprécient les API de Diffbot et ses ressources techniques avancées, en particulier pour extraire des données de réseaux sociaux. Cependant, certains utilisateurs estiment qu’il présente une courbe d’apprentissage, nécessitant une certaine familiarité avec son langage de requête. Diffbot propose un essai gratuit de deux semaines avec un accès complet à l’API, avec des tarifs à partir de 299 $.

6. Brightdata

Brightdata accompagne des entreprises de secteurs variés, notamment la finance, le retail, le voyage et la cybersécurité, qui cherchent à exploiter les données web à leur avantage. Le Brightdata Data Collector facilite la collecte de données web à grande échelle sans nécessiter de mise en place d’infrastructure. Les cas d’usage vont de l’étude de marché et du SEO au crawling des moteurs de recherche et à la surveillance des marchés boursiers. Brightdata fournit des données web structurées compatibles avec diverses applications. Le tarif du Data Collector commence à 350 $ pour 100 000 chargements de pages.

7. Web Scraper (extension Chrome)

L’extension Chrome Web Scraper est un puissant outil gratuit d’extraction de données capable de crawler et d’analyser des données web. Malgré son statut d’outil gratuit, elle offre des capacités importantes. Les utilisateurs peuvent extraire des données de sites dynamiques, notamment des catégories, des sous-catégories, des pages produits et la pagination. Web Scraper dispose d’une interface point-and-click et propose de nombreux exemples pour aider les utilisateurs à démarrer. Il permet de télécharger rapidement des tableaux et des listes au format CSV sans avoir besoin de coder. Bien que l’extension soit gratuite, des offres payantes sont disponibles pour ceux qui recherchent l’automatisation, des options d’export supplémentaires, un proxy, un parseur et une API. Les tarifs commencent à 50 $ par mois pour ces fonctionnalités.

8. Simplescraper

Simplescraper porte bien son nom en proposant un web scraping simplifié. Cet outil est entièrement gratuit et peut être téléchargé instantanément. Il permet d’effectuer le scraping localement, d’exécuter des recettes dans le cloud ou de créer une API. Chaque site web extrait devient une API, ce qui permet aux utilisateurs de récupérer des données fraîches de manière répétée. Simplescraper permet d’extraire des données de milliers de pages web en un seul clic, d’exporter vers Google Sheets et d’extraire des données à partir de liens grâce à un deep scraping. Un outil gratuit remarquablement puissant !

9. Scraper API

Scraper API convient aux entreprises de toutes tailles, des start-ups aux grandes entreprises. Cette solution d’extraction de données gère les proxies, les navigateurs et les CAPTCHA, permettant d’extraire n’importe quelle page web via un simple appel API. Les utilisateurs soumettent l’URL à partir de laquelle ils souhaitent extraire les données, et Scraper API renvoie le contenu HTML. Elle propose le géociblage, le contournement anti-bot, le rendu JavaScript, une assistance dédiée et des proxies résidentiels, ce qui en fait un outil de scraping très puissant. Scraper API propose un essai gratuit avec 5 000 crédits API, et les offres payantes commencent à 29 $ pour 250 000 crédits API.

10. ScrapingBee

ScrapingBee s’avère être un outil d’extraction de données robuste, adapté à diverses tâches de web scraping. Les équipes commerciales l’utilisent pour la génération de leads, l’extraction d’informations de contact et la récupération de données depuis les réseaux sociaux. Les marketeurs s’appuient sur ScrapingBee pour le growth hacking et les activités SEO, notamment le suivi de mots-clés et la vérification des backlinks, grâce à son vaste pool de proxies. ScrapingBee gère des instances headless avec la dernière version de Chrome, propose le rendu JavaScript et fait tourner les proxies pour minimiser le risque de blocage par les mesures anti-scraping. L’outil propose un essai gratuit avec 1 000 appels API, sans carte bancaire requise, et une offre d’entrée de gamme à partir de 49 $ par mois pour 100 000 crédits API.

Mises à jour de janvier 2026 dans l’extraction de données

La réglementation pousse l’extraction vers un accès auditable

En janvier 2026, l’extraction de données en Europe est façonnée par des règles qui récompensent l’accès autorisé et traçable aux données plutôt que le scraping incontrôlé. Le EU Data Act est appliqué depuis septembre 2025 et, même s’il ne s’agit pas d’une « loi sur le scraping », il renforce une évolution plus large : les entreprises sont censées mettre en place des moyens structurés d’accéder aux données et de les partager générées par les produits connectés et les services associés.

Pour les workflows B2B, cela réduit l’attrait à long terme des pipelines de scraping fragiles et augmente la valeur des stacks d’extraction capables de se connecter à des API, des exports autorisés et un partage de données compatible avec la gouvernance.

En parallèle, l’EU AI Act influence déjà la manière dont les fournisseurs développent les fonctionnalités d’extraction alimentées par l’IA. Même avant son application complète en août 2026, le marché évolue vers des attentes plus fortes en matière de journalisation, de transparence et de contrôles lorsque l’IA est utilisée pour l’enrichissement, la classification ou les signaux d’intention.

Le résultat est concret : davantage d’attention portée aux journaux d’audit, à l’explicabilité, aux politiques de conservation et aux contrôles utilisateur dans les produits d’extraction.

Les défenses anti-bot sont devenues une contrainte produit essentielle

2025 a marqué un tournant dans l’application des mesures anti-scraping, et l’impact est pleinement visible en 2026. Les défenses modernes s’appuient moins sur de simples blocages d’IP et davantage sur la détection comportementale, l’empreinte digitale et les défis adaptatifs.

Des fournisseurs comme Cloudflare ont publiquement mis en avant de nouvelles approches pour ralentir ou détourner les bots, en particulier ceux associés au crawling automatisé à grande échelle. Cela change les critères d’achat : les outils d’extraction ne sont plus impressionnants simplement parce qu’ils « peuvent tout extraire », ils ont de la valeur lorsqu’ils offrent un débit prévisible, des taux de réussite stables et une gestion claire des échecs.

Pour les équipes qui exécutent de vraies charges de travail, le nouveau niveau de référence est la maturité opérationnelle : retries intelligents, détection des blocages, stratégies de rendu pour les pages riches en JavaScript et observabilité permettant de voir où et pourquoi l’extraction échoue. En d’autres termes, les meilleures configurations d’extraction en 2026 ressemblent moins à des scrapers ponctuels qu’à des pipelines de données fiables.

Les sources first-party et basées sur le consentement gagnent en priorité

L’incertitude autour de la confidentialité et du suivi continue de remodeler les stratégies d’acquisition. Avec la pression persistante sur le suivi intersites et l’orientation claire vers des paramètres respectueux de la vie privée, de nombreuses organisations se tournent davantage vers les données first-party et consenties.

Cela n’élimine pas l’extraction web, mais cela déplace le centre de gravité : davantage de valeur provient désormais de l’extraction et de la structuration de données issues de points de contact détenus tels que les formulaires, portails, analytics produit, inscriptions à des événements, places de marché et interactions clients, puis de leur enrichissement de manière contrôlée.

Cela influence aussi les outils. L’extraction est de plus en plus associée à la validation des données et à la résolution d’identité, afin que la sortie puisse être activée rapidement sans polluer les CRM ou les analyses en aval.

L’indicateur de succès est passé du volume aux enregistrements exploitables

En 2026, les équipes avancées se soucient moins du coût par mille lignes et davantage du coût par enregistrement exploitable et enrichi. Cela signifie que la déduplication, la vérification, les contrôles de fraîcheur et les rafraîchissements planifiés ne sont pas des options agréables à avoir, mais des exigences de base.

Si un jeu de données ne peut pas être activé rapidement dans un CRM, une couche analytique ou un workflow de prospection, il est considéré comme un gaspillage opérationnel.

L’enseignement pratique est simple : les programmes d’extraction les plus solides optimisent désormais la durabilité, la conformité et la vitesse d’activation. L’extraction de données n’est plus seulement une capacité technique. C’est une couche stratégique qui relie la conformité, la fiabilité de l’infrastructure et les opérations revenue d’une manière capable de passer à l’échelle sans cassures constantes.

Mises à jour 2025 dans les outils d’extraction de données

En 2025, les outils d’extraction de données ont énormément évolué grâce à l’intégration de l’IA générative, de l’OCR avancé et de la vision par ordinateur. L’objectif n’est plus seulement de lire des PDF ou des sites web, mais de comprendre des documents dynamiques et de les transformer en données structurées prêtes à être intégrées à des systèmes ERP, CRM ou data warehouse. La tendance est claire : plus de précision, moins de modèles fixes et des déploiements plus rapides.

1. De l’OCR traditionnel au traitement intelligent des documents (IDP)

Les nouvelles plateformes de traitement intelligent des documents utilisent des modèles d’IA pré-entraînés pour extraire des données à partir de factures, de contrats et de bons de livraison, en s’adaptant automatiquement aux changements de mise en page.

Elles atteignent désormais des taux de précision supérieurs à 95 %, contre 60 à 80 % avec l’OCR traditionnel, et s’intègrent aux workflows RPA pour automatiser l’ensemble du processus d’extraction et de validation.

2. Extraction web sans code, alimentée par l’IA

Les outils modernes de web scraping permettent désormais d’extraire des données sans écrire de code. Des fonctionnalités comme la rotation automatique des proxies, la résolution des CAPTCHA et le nettoyage du HTML simplifient la collecte de données pour les équipes marketing, d’analytique et d’e-commerce.

Cela rend l’extraction de données plus accessible et plus efficace que jamais.

3. Des API prêtes pour une intégration fluide

La plupart des plateformes d’extraction de données incluent désormais des API natives qui envoient directement des informations structurées vers les systèmes cibles.

Des solutions comme Klippa, Procys et Airbyte convertissent du contenu non structuré en données prêtes à l’emploi en quelques minutes, réduisant le temps de configuration manuelle et la complexité.

4. Sécurité et conformité renforcées

À mesure que l’extraction de données sensibles augmente, les fournisseurs accordent une priorité accrue à la sécurité des données et à la conformité réglementaire, en respectant des normes telles que le RGPD, ISO 27001 et HIPAA — un domaine particulièrement important pour les rapports financiers et les secteurs réglementés.

Cela permet à l’extraction automatisée de s’étendre à la finance, la santé et l’assurance, où la protection des données est critique.

5. Des protections anti-scraping plus robustes

Les sites web mettent en place des technologies anti-scraping avancées pour lutter contre la collecte de données non autorisée.

Des plateformes comme Cloudflare et Reddit ont déployé des systèmes de détection et de blocage, incitant les outils professionnels à ajouter la détection des blocages et le routage adaptatif afin de maintenir des performances de scraping fiables.

6. L’entrée de grands acteurs du marché

De grands acteurs comme Box ont lancé leurs propres outils d’extraction alimentés par l’IA, tels que Box Extract, capables de traiter du texte, des images et même de l’audio.

Cela montre que l’extraction de données est devenue une capacité centrale dans les écosystèmes d’automatisation d’entreprise et de gestion de contenu.

Dans l’ensemble, l’extraction de données en 2025 est plus intelligente, plus rapide et plus conforme — une fonction stratégique qui aide les entreprises à rationaliser leurs opérations et à prendre des décisions fondées sur les données avec confiance.

L’avenir de l’extraction de données en 2025 : de l’automatisation à l’intelligence

L’extraction alimentée par l’IA devient contextuelle

L’ère du simple web scraping est révolue. En 2025, les outils d’extraction de données les plus avancés ont évolué de la simple capture d’informations brutes vers la compréhension de leur contexte et de leur pertinence.

Des plateformes comme Enginy, Diffbot et Captain Data combinent désormais des modèles d’IA, le traitement du langage naturel (NLP) et le machine learning pour interpréter le sens des données qu’elles collectent.

Au lieu de se limiter à extraire des noms d’entreprises ou des e-mails, ces outils détectent des signaux d’intention, des changements organisationnels et des déclencheurs en temps réel tels que des levées de fonds, des changements de direction ou des tendances de recrutement.

Cette conscience contextuelle transforme des listes statiques en ensembles de données intelligents et priorisés que les équipes commerciales et marketing peuvent exploiter immédiatement.

Par exemple, si un extracteur alimenté par l’IA identifie une entreprise SaaS qui recrute des commerciaux outbound et vient de lever une série A, il étiquette automatiquement l’enregistrement comme une opportunité à fort taux de conversion.

Cette combinaison d’enrichissement des données et d’analytique prédictive permet des décisions plus rapides et une prospection plus précise.

Le nouveau critère de référence n’est pas la quantité de données que vous pouvez collecter, mais la manière intelligente dont vous pouvez les utiliser.

Intégrer l’extraction dans la pile de données B2B

L’un des plus grands défis dans les opérations data consiste à faire circuler les données extraites de manière fluide entre les systèmes.

Les organisations B2B les plus performantes considèrent désormais l’extraction de données comme une couche centrale de leur infrastructure d’automatisation, et non comme une activité isolée.

La pile de données moderne comprend trois composants essentiels :

Couche de capture : des outils d’extraction comme Enginy ou Brightdata collectent des données structurées et semi-structurées depuis des sources publiques — sites web d’entreprises, LinkedIn, annuaires et sites d’avis.

Couche d’enrichissement : ces données brutes sont nettoyées, validées et enrichies avec des informations supplémentaires — comme l’ancienneté du poste, la taille de l’entreprise et les signaux d’intention — avant d’entrer dans le CRM.

Couche d’activation : les données enrichies sont synchronisées automatiquement avec les outils d’outreach, permettant des campagnes multicanales sur l’e-mail, LinkedIn et d’autres canaux.

Lorsque ces couches fonctionnent ensemble, les équipes obtiennent un flux continu d’informations vérifiées et en temps réel.

Ce processus, souvent appelé orchestration de données en direct, garantit que votre CRM et vos tableaux de bord d’analyse sont toujours exacts et exploitables.

Le bénéfice de l’intégration est clair : des données plus propres, des messages plus pertinents et moins de temps perdu en mises à jour manuelles.

Conformité et collecte éthique des données

À mesure que l’automatisation se développe, la surveillance s’intensifie. L’avenir de l’extraction de données dépend aussi de la transparence et de la conformité en matière de confidentialité.

Les fournisseurs mettent désormais l’accent sur l’alignement RGPD, la certification ISO 27001 et un approvisionnement responsable.

Des plateformes comme Enginy ont intégré la conformité dans leur conception — en ne stockant que des données publiquement disponibles, en anonymisant les identifiants personnels et en conservant des journaux d’audit pour chaque enregistrement.

L’extraction éthique ne fait pas qu’éviter les risques ; elle instaure la confiance. En 2025, les clients attendent de la responsabilité dans la manière dont les données sont collectées et utilisées, et les entreprises qui donnent la priorité à cet aspect gagnent un avantage concurrentiel durable.

Maximiser le ROI et la scalabilité dans l’extraction de données

Calculer le véritable retour sur l’automatisation des données

Les indicateurs traditionnels comme le « coût pour 1 000 enregistrements » ne suffisent plus.

Le véritable indicateur de performance des workflows d’extraction modernes est le coût par enregistrement enrichi (CER) — le prix payé pour des données vérifiées et exploitables qui convertissent réellement.

Mesurés de cette manière, les outils d’extraction pilotés par l’IA surpassent régulièrement les scrapers manuels ou à bas coût. Même s’ils peuvent coûter légèrement plus cher au départ, leur vérification, déduplication et enrichissement intégrés réduisent drastiquement les efforts inutiles.

Conclusion : l’option la moins chère n’offre que rarement la meilleure valeur. Lorsque l’automatisation s’accompagne d’enrichissement par l’IA, la précision, la vitesse et le ROI augmentent simultanément.

Construire un workflow de données automatisé et scalable

Faire passer l’extraction de données à l’échelle ne consiste pas à ajouter davantage d’outils — il s’agit de concevoir un écosystème connecté. Voici un cadre pratique en trois étapes utilisé par des équipes B2B en forte croissance :

Auditer et préparer : examinez votre CRM et supprimez les doublons ou les enregistrements obsolètes. Définissez ce que signifie « donnée de haute qualité » pour votre équipe — par exemple, e-mail vérifié, fonction actuelle, taille de l’entreprise.

Automatiser la collecte : mettez en place des extracteurs pilotés par l’IA comme Enginy ou Captain Data pour récupérer en continu de nouvelles informations depuis des sources en ligne pertinentes. Configurez des workflows pour actualiser les champs clés (comme les intitulés de poste ou les firmographiques) tous les 30 à 45 jours.

Activer et mesurer : connectez vos données enrichies à des plateformes d’automatisation comme HubSpot, Apollo ou LinkedIn Sales Navigator. Suivez les taux de rendez-vous, le temps de réponse et les taux de conversion pour 1 000 leads enrichis.

En 60 jours, les équipes qui suivent cette structure réduisent généralement la recherche manuelle de 70 % et constatent une augmentation de 2 à 3 fois de l’efficacité de l’outbound.

Tendances futures et ce qui arrive ensuite

À l’avenir, l’extraction de données continuera de fusionner avec l’IA commerciale autonome.

Des agents alimentés par des outils comme Enginy AI traiteront automatiquement les données extraites, engageront la conversation et géreront les relances — bouclant ainsi la chaîne de la donnée au dialogue.

Nous verrons également apparaître des innovations telles que :

Des API d’enrichissement en temps réel qui diffusent instantanément des contacts vérifiés dans les CRM.

Des crawlers autonomes qui découvrent de nouvelles sources sans intervention humaine.

Des modèles d’extraction prédictive qui prévoient quels leads ont le plus de chances de convertir en fonction des schémas d’engagement passés.

La prochaine étape est claire : l’extraction de données devient une extraction d’intelligence — un processus continu qui alimente la prise de décision, et pas seulement les bases de données.

En conclusion, les entreprises qui souhaitent exploiter la puissance des données disposent d’une multitude d’outils d’extraction de données. Que vous soyez un professionnel des données expérimenté ou débutant dans le monde de l’extraction de données, ces outils offrent des options variées pour répondre à vos besoins et objectifs spécifiques. Explorez les fonctionnalités et les capacités de chaque outil afin de déterminer celui qui correspond le mieux aux exigences d’extraction de données de votre entreprise en 2025.