10 estrategias esenciales de tests A/B en mails en frío en 2026

Andrea López

Compartir

Estas son las mejores estrategias de tests A/B en mails en frío para mejorar conversión en 2026:

Define el objetivo correcto (olvida los opens como métrica principal)

Testea la oferta y el angle antes que el asunto

Optimiza la primera frase (primeros 150 caracteres)

Experimenta con diferentes CTAs (llamadas a acción)

Encuentra la longitud ideal para tu audiencia

Diseña experimentos que aíslen causalidad real

Calcula el tamaño de muestra antes de empezar

Evita parar el test cuando parece que gana

Vigila entregabilidad durante el test

Mide respuesta positiva de forma operativa

Los tests A/B en mails en frío en 2026 ya no van de cambiar el asunto y celebrar un open rate.

Entre la privacidad (que distorsiona aperturas), los filtros más agresivos y la realidad de la prospección multicanal, optimizar de verdad significa medir conversaciones útiles: respuestas positivas, reuniones agendadas y conversión a pipeline, sin cargarte la entregabilidad por el camino.

La diferencia entre un test que te hace crecer y uno que te engaña suele estar en lo básico: una hipótesis clara, una sola variable por experimento, aleatorización real y guardarraíles que no se negocian ( rebotes, quejas de spam, bajas, inbox placement ).

Si no controlas esto, el “ganador” puede ser simplemente el email que se entrega mejor, no el que convierte mejor.

En este post tienes 10 estrategias esenciales para hacer tests A/B en mails en frío con rigor: priorizar oferta y ángulo sobre detalles cosméticos, optimizar los primeros 150 caracteres, ajustar CTAs según el nivel de conciencia del problema, calcular tamaño muestral, definir criterios de parada y, sobre todo, aprender por segmentos para que tus conclusiones sean transferibles y no puro ruido.

10 estrategias esenciales de tests A/B en mails en frío para mejorar conversión en 2026

1. Define el objetivo correcto (olvida los opens como métrica principal)

El open rate es una señal débil y cada vez menos fiable. Apple Mail Privacy Protection precarga contenido, puede inflar aperturas y ocultar datos reales de ubicación y tiempo. Optimizar solo por opens te lleva a conclusiones falsas.

Mejor jerarquía de métricas:

KPI primario: tasa de respuesta positiva o tasa de reunión agendada

Secundarias: reply total, CTR si usas links, conversion rate a demo

Guardarraíles: rebote, quejas de spam, bajas, delivery/inbox placement

Gmail recomienda mantener el spam rate por debajo del 0,10% y evitar llegar al 0,30% o más. En Outlook, el complaint rate debe mantenerse por debajo del 0,3% según SNDS.

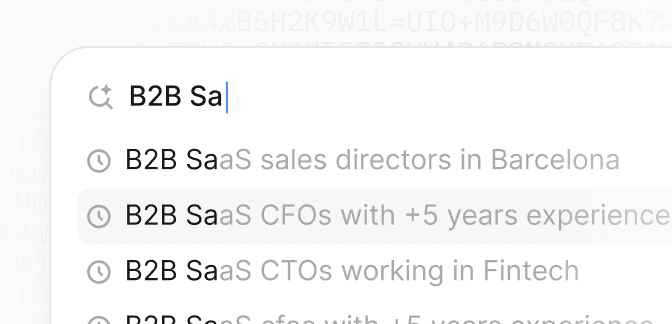

2. Testea la oferta y el "angle" antes que el asunto

La primera variable que debes testear es la que más impacta en respuesta: tu propuesta de valor.

Variables de oferta con mayor impacto:

Dolor o trigger principal (coste, riesgo, tiempo, ingresos)

Promesa concreta vs genérica

Nivel de fricción: "¿Te va bien 15 min?" vs "¿A quién debería escribir?"

Empieza por cambiar el ángulo completo de tu mensaje antes de obsesionarte con asuntos. Una oferta débil no se salva con un asunto ingenioso.

3. Optimiza la primera frase (primeros 150 caracteres)

Los primeros 150 caracteres son lo que el prospecto ve en el preview del email. Aquí decides si abre o no.

Testa:

Personalización real (evento reciente, señal pública) vs plantilla genérica

Pregunta directa vs afirmación corta

Contexto relevante vs pitch directo

La personalización genuina basada en investigación real siempre supera a la plantilla con tokens dinámicos. No es lo mismo "Vi que contratasteis a un Head of Sales en diciembre" que "Hola {{nombre}}".

4. Experimenta con diferentes CTAs (llamadas a acción)

El CTA define la fricción de tu mensaje. Un CTA de un paso (directamente a reunión) puede funcionar con audiencias cálidas, pero un CTA de dos pasos suele tener mejor respuesta en mails en frío.

Opciones para testear:

CTA de 1 paso: "¿Te va bien el martes o jueves a las 11h?"

CTA de 2 pasos: "¿Tiene sentido que hablemos 15 min?"

CTA cerrada vs abierta

Pregunta directa vs propuesta suave

Según tu ICP y nivel de conciencia del problema, el CTA óptimo varía radicalmente.

5. Encuentra la longitud ideal para tu audiencia

No hay una longitud "perfecta" para todos los ICPs. 40-70 palabras suele funcionar para decisores muy ocupados, mientras que 90-130 palabras puede funcionar mejor para buyers técnicos que necesitan contexto.

Testa:

Email corto y directo vs email con más contexto

1 idea por email vs 2 ideas (más info, más ruido)

Estructura de párrafos: uno largo vs varios cortos

La regla general: cuanto más senior el cargo, más corto el email. Pero siempre testea con tu audiencia real.

6. Diseña experimentos que aíslen causalidad real

Un test mal diseñado te da ganadores falsos. Para aislar causalidad real:

Reglas mínimas:

1 hipótesis, 1 variable principal, 1 KPI

Aleatorización real (random) a nivel lead

Mantén constantes: dominio, sending pattern, número de follow-ups, segmentación, calendario

No mezcles ICPs: estratifica por tipo de dominio (gmail/outlook/corporate), país o vertical

Si testeas asunto Y longitud Y CTA a la vez, no sabrás cuál causó el resultado. Un cambio por test.

7. Calcula el tamaño de muestra antes de empezar

En mails en frío, las tasas son bajas (1%-8%). Con conversiones bajas, necesitas mucha muestra para detectar mejoras reales.

Ejemplos orientativos (por variante):

Baseline 4% → 5,5% (+1,5 puntos): ~3.100 contactos por variante

Baseline 4% → 5% (+1 punto): ~6.700 por variante

Baseline 1% → 1,5% (+0,5 puntos): ~7.700 por variante

Si no tienes ese volumen, no fuerces significancia. Acumula tests, usa ciclos semanales, o agrupa aprendizajes por segmentos parecidos. Herramientas como Optimizely o Evan Miller ofrecen calculadoras de tamaño muestral para pruebas de proporciones.

8. Evita parar el test cuando "parece que gana"

Mirar resultados cada hora y parar cuando te gusta el ganador infla falsos positivos. Define el criterio de parada antes de empezar.

Trampas estadísticas comunes:

Parar cuando "parece que gana" (problema de muestreo secuencial mal ajustado)

Probar demasiadas variantes a la vez (multiple comparisons)

Solución: define muestra mínima o testing secuencial bien planteado antes de empezar. Respeta el criterio aunque te cueste.

9. Vigila entregabilidad durante el test

Tus tests pueden "ganar" por razones equivocadas. Si cambias cosas que afectan filtros (tracking agresivo, enlaces, palabras spammy), puedes modificar inbox placement y sesgar el resultado.

Señales a vigilar:

Gmail exige autenticación (SPF, DKIM, DMARC) para bulk senders

Outlook endurece criterios para high-volume senders (enrutado a Junk para no conformes desde mayo 2025)

Implementa baja fácil y one-click unsubscribe con RFC 8058

Añade guardarraíles "stop-loss": si rebote o quejas suben por encima de umbral, paras aunque el KPI suba.

10. Mide "respuesta positiva" de forma operativa

Clasifica respuestas automáticamente pero revisa una muestra:

Positiva: interés real, pide info, acepta reunión, deriva a decisor

Neutral: "ahora no", "en Q2", "envíame algo"

Negativa: "no", "no encaja", "baja"

Ruido: OOO, auto-replies, rebotes

Optimiza por "positivas" y "reuniones", no por reply total. Una tasa de reply del 15% no significa nada si el 12% son "no interesa".

Por qué el tests A/B en mails en frío es diferente al email marketing

Volúmenes bajos y conversiones más complejas

En email marketing tradicional puedes hacer tests con millones de envíos y optimizar por clicks. En mails en frío, trabajas con cientos o miles de contactos y optimizas por conversaciones reales.

Esto cambia todo:

Necesitas más disciplina en diseño experimental

Los tamaños de muestra son más pequeños, así que la significancia estadística es más difícil de alcanzar

No puedes darte el lujo de "probar 10 variantes" a la vez

La entregabilidad es más frágil

En mails en frío, tu reputación de dominio se construye lentamente y se destruye rápido. Un test mal ejecutado puede quemar tu dominio en días.

Diferencias clave:

En marketing: los usuarios se suscribieron, engagement alto, baja tasa de spam

En mails en frío: contacto no solicitado, engagement bajo, alta sensibilidad a filtros

Por eso, cada test debe incluir guardarraíles de entregabilidad.

El contexto importa más que el copy

En mails en frío, el timing, el ICP, y el canal importan tanto o más que las palabras exactas. Un mensaje perfecto enviado a la persona equivocada o en el momento equivocado fracasa.

Esto significa que debes estratificar tus tests por segmentos relevantes: cargo, vertical, tamaño de empresa, geografía. Lo que funciona para CTOs en startups tech puede fallar completamente con CFOs en manufacturing.

Los mayores errores al hacer tests A/B en mails en frío

1. Testear sin volumen suficiente

El error más común: lanzar un test con 100 emails por variante y declarar ganador al que tiene 2 respuestas más.

Con conversiones del 3-5%, necesitas miles de contactos para detectar mejoras del 1-2%. Si no tienes ese volumen, es mejor:

Acumular aprendizajes durante varias semanas

Testear cambios más grandes (diferencia mínima detectable del 3-5%)

Usar un enfoque cualitativo y aprender de las respuestas que recibes

2. Cambiar múltiples variables a la vez

Testeas asunto, longitud, CTA y oferta simultáneamente. El resultado "gana" pero no sabes por qué.

Consecuencia: no puedes replicar el aprendizaje en otras campañas. El conocimiento no es transferible.

Solución: 1 hipótesis, 1 variable, 1 test.

3. Ignorar la segmentación del ICP

Lo que funciona para un segmento puede fallar completamente en otro. Un mensaje que resuena con startups tech puede sonar ridículo para empresas industriales tradicionales.

Problema: promedias resultados de ICPs muy distintos y sacas conclusiones inválidas.

Solución: estratifica por variables clave (vertical, tamaño, cargo, geografía) y analiza resultados por segmento.

4. Optimizar por métricas equivocadas

Optimizas por open rate porque es fácil de medir. El problema: los opens no se traducen en reuniones.

Trampas de métricas:

Open rate: inflado por Apple Mail Privacy, no predice respuesta

Reply rate total: incluye "no interesa", OOOs y rebotes

CTR: clicks sin contexto no generan pipeline

Solución: optimiza por respuesta positiva, conversaciones útiles y reuniones agendadas.

Cómo la prospección multicanal afecta el tests A/B

Email + LinkedIn + llamadas = contexto completo

Tradicionalmente la prospección comercial se realiza por canales aislados (email, LinkedIn, teléfono…). Esto fragmenta el contexto y dificulta entender qué canal o mensaje generó la respuesta.

En prospección multicanal:

Un prospecto puede ver tu email, visitar tu LinkedIn, y responder días después

La "conversión" puede venir de la combinación de touchpoints, no de uno solo

Medir atribución se vuelve complejo

Implicación para tests A/B: si haces outreach multicanal, tus tests de email deben considerar el efecto de otros canales.

Testea cadencias completas, no mensajes aislados

En lugar de testear solo el primer email, testea la cadencia completa:

Email 1 (día 0) + LinkedIn connection (día 2) + Email 2 (día 5) + llamada (día 7)

vs

Email 1 (día 0) + Email 2 (día 3) + LinkedIn message (día 5) + Email 3 (día 8)

Esto requiere más volumen y diseño experimental más robusto, pero te da aprendizajes mucho más accionables sobre el flujo completo.

Atribución: cuál fue el touchpoint que generó la respuesta

Si alguien responde después de recibir 3 emails y 2 mensajes de LinkedIn, ¿cuál generó la conversión?

Modelos de atribución posibles:

First-touch: el primer contacto se lleva el crédito

Last-touch: el último touchpoint antes de responder

Multi-touch: distribución proporcional entre todos los touchpoints

Time-decay: más peso a los touchpoints recientes

Para mails en frío, el modelo más útil suele ser last-touch o time-decay, porque los prospectos suelen responder tras ver tu mensaje varias veces.

El papel de la infraestructura técnica en el tests A/B

Autenticación: SPF, DKIM y DMARC

Si tu autenticación no está bien configurada, puedes "ganar" un test simplemente porque una variante se entrega mejor, no porque el copy sea mejor.

Requisitos mínimos:

SPF: autoriza IPs/hosts a enviar para tu dominio

DKIM: firma criptográfica que valida que el mensaje no fue modificado

DMARC: conecta SPF y DKIM con el dominio del From y define política

Gmail especifica que para correo directo, el dominio del From: debe alinearse con el dominio SPF o DKIM para cumplir DMARC. Microsoft tiene requisitos similares para high volume senders.

Para tests A/B: mantén la misma configuración de autenticación en todas las variantes. Si cambias dominios de envío entre A y B, introduces una variable técnica que sesga resultados.

Dominios de envío y warmup

Un dominio nuevo sin reputación tendrá peor entregabilidad que uno establecido. Si testas usando dominios distintos, no estás testeando copy, estás testeando reputación.

Reglas:

Usa el mismo subdominio de envío para todas las variantes del test

Si necesitas escalar y añadir dominios, hazlo después del test, no durante

Mantén el mismo warmup pattern (volumen, frecuencia, engagement) entre variantes

Tracking pixels y enlaces: cómo afectan filtros

Los tracking pixels y acortadores de URLs pueden disparar filtros de spam.

Impacto en tests A/B:

Si una variante lleva tracking agresivo y la otra no, la diferencia de entregabilidad puede ser enorme

Los acortadores (bit.ly, ow.ly) son señal de spam para muchos filtros

Gmail y Outlook pueden filtrar emails con ratio alto de links

Solución: mantén el mismo nivel de tracking y misma estructura de enlaces en todas las variantes. Si quieres testear CTAs con links, usa el mismo número de links con URLs de longitud similar.

Seed testing para medir inbox placement

Puedes "ganar" un test porque una variante cae menos en spam, no porque genere más respuestas.

Seed testing te permite medir placement (inbox vs spam vs missing) con cuentas control antes de escalar.

Cómo aplicarlo:

Envía A y B con el mismo patrón a una lista de semillas (cuentas Gmail, Outlook, corporate)

Mide placement real: cuántos llegan a inbox, cuántos a spam

Si A "gana" en respuestas pero su placement cae en spam en ciertos proveedores, estás comprando rendimiento a corto plazo y degradación a medio

Herramientas de deliverability suelen ofrecer seed tests, pero puedes crear tu propio setup con cuentas de prueba.

Consideraciones legales y compliance en España/UE

LSSI y consentimiento previo

En España, el envío de comunicaciones comerciales por email está condicionado por la LSSI (regla general: consentimiento previo; excepción típica: relación contractual previa y productos/servicios similares).

Para outbound B2B frío, esto genera fricción legal. La AEPD lo ha reiterado en resoluciones y criterios.

Minimiza riesgo:

Transparencia: quién eres, por qué contactas

Baja clara en el primer email

Registros de oposición y supresión

Revisión con asesoría legal según país, tipo de dato y destinatario

RGPD y bases jurídicas para tratamiento de datos

Para el tratamiento de datos personales en marketing directo bajo RGPD, debes tener base jurídica, respetar expectativas razonables y el derecho de oposición.

Bases jurídicas más comunes en B2B:

Consentimiento: difícil de obtener en mails en frío

Interés legítimo: posible si el prospecto es relevante para tu negocio y la prospección es razonable

Ejecución de contrato: solo si ya hay relación previa

El marco de ePrivacy también influye. La combinación RGPD + ePrivacy + LSSI hace que el mails en frío B2B en España sea un terreno complejo.

Impacto en tests A/B

Problema: si tu base legal es débil o tu proceso de baja no es claro, puedes recibir más quejas de spam en ciertos tests, no por el copy sino por la percepción de intrusión.

Solución:

Incluye siempre un mecanismo de baja claro (preferiblemente one-click)

Añade transparencia sobre quién eres y por qué contactas

Mantén listas de supresión actualizadas y respeta bajas inmediatamente

Considera que algunos tests pueden aumentar fricción legal si son más agresivos en tono o frecuencia

Plantilla de briefing para cada A/B test

Antes de lanzar cualquier test, documenta:

1. Hipótesis: "Si cambiamos X, subirá Y porque Z"

2. Variable: solo una (oferta, primera línea, CTA, longitud, asunto)

3. KPI: respuesta positiva / reunión agendada

4. MDE (mínima diferencia detectable): mejora mínima que compensa el esfuerzo (ejemplo: +1 punto de respuesta)

5. Muestra mínima por variante: calculada con herramienta estadística

6. Segmentos: ICP y estratos (gmail/outlook/corporate, país, vertical, cargo)

7. Guardarraíles: rebote <2%, spam complaints <0,1%, bajas <0,5%

8. Criterio de parada: fecha fija o n mínimo alcanzado

9. Decisión: gana A / gana B / inconcluso (no hay significancia)

10. Aprendizaje documentado: qué reutilizas y en qué campañas futuras

Este briefing te obliga a pensar antes de ejecutar y evita tests improvisados que desperdician volumen.

3 escenarios reales donde el tests A/B impulsa resultados

Startup SaaS escalando outbound con equipo pequeño

Una startup con 2 SDRs necesita maximizar cada contacto. No pueden permitirse desperdiciar leads con mensajes genéricos.

Uso de tests A/B:

Testean oferta (ROI vs ahorro de tiempo) con 1.500 leads por variante

Descubren que "ahorro de tiempo" genera +2,3 puntos de respuesta positiva

Aplican el aprendizaje a todas las cadencias futuras

En 3 meses, duplican reuniones sin aumentar volumen

Clave: con poco volumen, priorizan tests de alto impacto (oferta, angle) antes que detalles (asunto, firma).

Empresa industrial lanzando nuevo producto

Una empresa B2B industrial quiere validar mensajes para un nuevo producto antes de invertir en más SDRs.

Uso de tests A/B:

Testean 3 ángulos distintos: reducción de coste, cumplimiento normativo, eficiencia operativa

Segmentan por vertical: manufacturing vs logística vs construcción

Descubren que cumplimiento normativo funciona mejor en construcción, pero reducción de coste gana en manufacturing

Resultado: personalizan mensajes por vertical y mejoran tasa de reunión +40% vs mensaje genérico.

Clave: segmentación por ICP y aprendizajes específicos por vertical.

Agencia de growth testando cadencias multicanal

Una agencia gestiona outbound para varios clientes y quiere optimizar cadencias completas.

Uso de tests A/B:

Cadencia A: Email (día 0) → LinkedIn (día 2) → Email (día 5) → Llamada (día 8)

Cadencia B: Email (día 0) → Email (día 3) → LinkedIn (día 5) → Email (día 7)

Miden atribución por last-touch y time-decay

Resultado: Cadencia A genera más respuestas tempranas, pero Cadencia B tiene mejor tasa de reunión final (+15%).

Clave: testear flujos completos, no mensajes aislados.

Por qué Enginy AI facilita el tests A/B en mails en frío sin sacrificar entregabilidad

Hacer tests A/B riguroso en mails en frío requiere infraestructura, datos limpios, y ejecución consistente. Aquí es donde muchas empresas se atascan: quieren testear pero no tienen el setup necesario.

Datos enriquecidos y segmentación precisa

Enginy agrega datos desde 30+ fuentes y usa enriquecimiento en cascada con múltiples proveedores. Esto te da:

Cobertura completa: emails válidos, cargos actualizados, señales de intención

Segmentación precisa: puedes estratificar tests por vertical, tamaño, cargo, geografía

Higiene de datos: reduces rebotes y mejoras entregabilidad desde el inicio

Cuando tus datos son limpios y completos, tus tests son más fiables porque eliminas ruido causado por emails inválidos o cargos incorrectos.

Ejecución multicanal con consistencia

Tradicionalmente la prospección comercial se realiza por canales aislados (email, LinkedIn, teléfono…). Con Enginy, puedes integrar toda la prospección en un solo flujo automatizado, con datos centralizados para tomar decisiones más inteligentes.

Esto facilita el tests A/B de cadencias completas:

Email + LinkedIn + seguimiento en un flujo único

Atribución clara de qué touchpoint generó la respuesta

Consistencia en timing y secuencia entre variantes

Cuando todos los canales están conectados, puedes testear estrategias completas en lugar de mensajes aislados.

Infraestructura de entregabilidad controlada

Enginy te permite mantener guardarraíles técnicos durante los tests:

Misma autenticación (SPF, DKIM, DMARC) en todas las variantes

Monitoreo de rebotes, spam complaints y placement

Warmup controlado y volumen consistente

Esto asegura que tus "ganadores" realmente son mejores en copy, no simplemente mejor entregados por configuración técnica distinta.

Integración con CRM para medir conversión real

Enginy se integra fácilmente con los CRMs existentes (HubSpot, Salesforce, Pipedrive), sin necesidad de sustituirlos. Esto te permite:

Medir conversión end-to-end: desde email hasta reunión y oportunidad

Calcular ROI real de cada variante

Cerrar el loop entre outreach y pipeline

Sin integración con CRM, solo puedes medir respuestas. Con integración, mides impacto en negocio.

Productividad: haz más tests sin más recursos

Enginy AI permite a los equipos de ventas ser mucho más productivos, automatizando tareas repetitivas y ahorrando horas de trabajo.

En lugar de configurar manualmente cada test, segmentar listas, lanzar cadencias y consolidar resultados en hojas de cálculo, puedes:

Configurar tests en minutos

Ejecutar variantes con consistencia automática

Obtener reportes de resultados segmentados por ICP

Esto significa que puedes hacer más tests con menos esfuerzo y aprender más rápido.

Preguntas Frecuentes (FAQs)

¿Qué es el tests A/B en mails en frío?

El tests A/B en mails en frío es un método experimental donde envías dos versiones de un mensaje (A y B) a grupos aleatorios de prospectos para determinar cuál genera mejores resultados. A diferencia del email marketing, en mails en frío optimizas por respuestas positivas y reuniones, no por clicks.

¿Cuántos contactos necesito para un A/B test válido?

Depende de tu baseline (tasa de conversión actual) y la mejora mínima que quieres detectar. Como referencia:

Para pasar de 4% a 5,5% de respuesta positiva: ~3.100 contactos por variante

Para pasar de 4% a 5%: ~6.700 por variante

Para pasar de 1% a 1,5%: ~7.700 por variante

Sin volumen suficiente, es mejor acumular aprendizajes durante varias semanas o testear cambios más grandes.

¿Qué debo testear primero en mails en frío?

Prioriza variables con mayor impacto en respuesta:

Oferta y angle: dolor principal, promesa, nivel de fricción

Primera frase (primeros 150 caracteres): personalización vs plantilla

CTA: 1 paso vs 2 pasos, cerrado vs abierto

Longitud y estructura: corto vs contexto adicional

Deja asuntos y firmas para después. La oferta importa 10x más que el asunto.

¿Por qué el open rate no es una buena métrica?

Apple Mail Privacy Protection precarga contenido y puede inflar opens artificialmente. Además, opens no predicen respuestas positivas: alguien puede abrir por curiosidad y nunca responder.

Métricas mejores:

Tasa de respuesta positiva (interés real, aceptan reunión)

Tasa de reunión agendada

Conversion rate a oportunidad en CRM

Optimiza por conversaciones útiles, no por curiosidad.

¿Cómo evito quemar mi dominio durante los tests?

Guardarraíles de entregabilidad:

Mantén spam complaints <0,1% (Gmail recomienda <0,10%)

Mantén bounce rate <2%

Implementa autenticación completa: SPF, DKIM, DMARC

Usa one-click unsubscribe (RFC 8058)

No cambies infraestructura técnica entre variantes

Si una variante aumenta quejas o rebotes, páraла inmediatamente aunque el KPI suba.

¿Puedo testear múltiples variables a la vez?

Técnicamente sí (diseño factorial), pero no es recomendable para la mayoría de equipos. Testear múltiples variables requiere:

Mucha más muestra (4x para un 2x2 factorial)

Análisis estadístico más complejo

Riesgo de interacciones que confunden resultados

Mejor enfoque: 1 hipótesis, 1 variable, 1 test. Aprende, aplica, repite.

¿Cómo mido si una respuesta es "positiva"?

Clasifica manualmente una muestra y luego automatiza:

Positiva: "me interesa", "hablemos", "cuéntame más", deriva a decisor, acepta reunión

Neutral: "ahora no", "prueba en Q2", "mándame info"

Negativa: "no interesa", "no encaja", "baja de la lista"

Ruido: OOO, auto-replies, rebotes

Optimiza solo por positivas. Una tasa de reply del 15% no sirve si el 12% son "no gracias".

¿Cuánto tiempo debe durar un A/B test?

Depende de tu volumen de envío y ciclo de respuesta:

Mínimo: tiempo para alcanzar muestra mínima calculada

Recomendado: 2-3 semanas para capturar respuestas tardías y efectos de follow-ups

Máximo: 1 mes (después de eso, factores externos pueden contaminar)

Regla: define criterio de parada antes de empezar y respétalo, incluso si "parece que gana" antes.

¿Cómo afecta el tests A/B si hago outreach multicanal?

En prospección multicanal (email + LinkedIn + llamadas), el tests A/B se complica porque la conversión puede venir de la combinación de touchpoints.

Mejor enfoque:

Testea cadencias completas, no mensajes aislados

Usa atribución last-touch o time-decay para asignar crédito

Mantén todos los canales constantes excepto la variable que testas

Si cambias email y LinkedIn a la vez, no sabrás cuál generó el resultado.

¿Enginy puede ayudarme con tests A/B en mails en frío?

Sí. Enginy facilita tests A/B riguroso al proporcionar:

Datos enriquecidos desde 30+ fuentes para segmentación precisa

Ejecución multicanal consistente (email + LinkedIn) en un solo flujo

Infraestructura controlada para mantener entregabilidad estable

Integración con CRM para medir conversión real (reuniones, oportunidades)

Automatización que te permite hacer más tests sin más recursos

Esto permite testear estrategias completas con rigor, no solo cambiar asuntos.