Melhores ferramentas de extração de dados de 2026, mais inteligentes, mais rápidas, automatizadas

Andrea Lopez

Partilhar

Ferramentas de extração de dados em 2026 tornaram-se essenciais para empresas que dependem de informação precisa e em tempo real para impulsionar o crescimento. Num mundo em que os dados alimentam tudo, desde geração de leads até análise competitiva e previsão de tendências de mercado, estas ferramentas tornam possível recolher, limpar e estruturar dados da web automaticamente e em escala.

O desafio para a maioria das empresas já não é o acesso aos dados, mas sim como extraí-los de forma eficiente, sem desperdiçar tempo nem correr riscos de conformidade.

As modernas ferramentas de extração de dados resolvem isto ao combinar IA, automação e interfaces sem código, transformando conteúdo web não estruturado em insights acionáveis, prontos a usar em CRMs, dashboards ou plataformas de análise.

Neste guia, vamos explicar o que a extração de dados realmente significa em 2026, porque se tornou uma capacidade tão estratégica para equipas B2B e empresariais, e quais as ferramentas que lideram o caminho em velocidade, escalabilidade e automação inteligente.

Compreender a Extração de Dados

O que é a Extração de Dados?

A extração de dados é o processo de recuperar informação de diversas fontes para obter insights e tomar decisões empresariais informadas. Esta informação pode ser estruturada, não estruturada ou parcialmente estruturada, dependendo da origem — uma prática essencial para empresas cotadas em bolsa e organizações que dependem de acesso atempado e em conformidade aos dados empresariais.

Por exemplo, em vendas B2B, a extração de dados pode envolver a recolha de informações de leads a partir das redes sociais para criar uma lista segmentada de potenciais clientes. No entanto, a automação excessiva ou o scraping podem, por vezes, desencadear restrições nas redes sociais, pelo que compreender os limites das plataformas é essencial antes de executar extração de dados em grande escala.

A extração de dados serve como a fase inicial do processo ETL (Extract, Transform & Load). As ferramentas ETL pegam em dados brutos de várias fontes e preparam-nos para integração noutro sistema, garantindo que estão no formato certo para análise. Um exemplo de uma ferramenta que funciona de forma semelhante ao ETL é o Captain Data, que executa tarefas como recolher dados de múltiplas fontes web, agregar dados brutos em informação estruturada e integrá-la perfeitamente no seu CRM ou noutras ferramentas.

Porque é que as Empresas Precisam de Extração de Dados

As empresas dependem da extração de dados por várias razões:

Construir bases de dados com informação relevante e atualizada.

Gerar insights acionáveis para estratégias de vendas e marketing.

Melhorar a qualidade dos dados, focando-se em fontes pertinentes e minimizando erros humanos.

Obter uma compreensão mais profunda do mercado e da concorrência. Isto é particularmente verdadeiro quando combinado com buying signals b2b, que ajudam as equipas a compreender a intenção para além dos conjuntos de dados brutos — insights que muitas vezes revelam novas oportunidades de negócio para equipas de vendas e marketing.

Como Funciona a Extração de Dados

Embora o motor de pesquisa da Google ofereça um exemplo de extração de dados ao rastrear websites e extrair informação para resultados de pesquisa, este artigo foca-se principalmente na extração de dados estruturados, frequentemente designada por “smart data”. Os dados estruturados estão bem organizados e prontos para análise. Software de automação, como o Captain Data, utiliza técnicas de web scraping para recolher estes smart data.

Web Scraping ou Extração de Dados Web

O web scraping envolve a extração de dados publicamente disponíveis de websites, permitindo a agregação rápida de informação valiosa para introdução numa base de dados. Os tipos de dados que podem ser extraídos incluem emails, números de telefone e moradas postais. O web scraping pode ser dividido em dois tipos: manual e automatizado.

Scraping manual envolve copiar e colar informações manualmente para uma base de dados ou folha de cálculo, sendo adequado para tarefas de extração de dados em pequena escala.

Scraping automatizado, por outro lado, utiliza ferramentas de extração de dados que extraem rapidamente grandes volumes de dados de fontes online.

O web scraping é particularmente valioso para equipas de vendas, pois ajuda em:

Compilar listas de empresas-alvo e leads a partir de fontes como redes sociais, SalesNavigator, Google Maps, Páginas Amarelas e outras.

Identificar decisores-chave e potenciais oportunidades de negócio.

Enriquecer e classificar leads.

Poupar tempo ao automatizar a introdução manual de dados, melhorando simultaneamente a precisão através de avançadas ferramentas de enriquecimento de dados que complementam os fluxos de trabalho de extração.

Apresentação das Ferramentas de Extração de Dados

O que Fazem as Ferramentas de Extração de Dados?

As ferramentas de extração de dados utilizam automação para extrair dados de formulários, websites, emails e outras fontes online. As ferramentas de extração de dados utilizam automação para extrair dados de formulários, websites, emails e outras fontes online, servindo muitas vezes como base para enriquecimento de dados em CRM e qualificação de leads.

Estas ferramentas enquadram-se em várias categorias:

Soluções SaaS

Extensões do Chrome

Bots de scraping/APIs de web scraping

Bibliotecas open source

Proxies e datasets

Os Benefícios do Software de Extração de Dados

O software de extração de dados oferece inúmeras vantagens, incluindo:

Poupança de Tempo: A automação reduz o esforço manual necessário para os processos de dados.

Maior Eficiência: Fazer mais em menos tempo.

Facilidade de Utilização: Ferramentas de extração de dados sem código simplificam a configuração de fluxos de trabalho de automação de dados, mesmo para utilizadores não técnicos.

Precisão: Minimizar o risco de erro humano.

Escalabilidade: Aceder rapidamente a grandes volumes de dados estruturados para o crescimento do negócio, como geração de leads e oportunidades de vendas.

Agora, vamos mergulhar nas 10 principais ferramentas de extração de dados.

As 10 Melhores Ferramentas de Extração de Dados para 2026

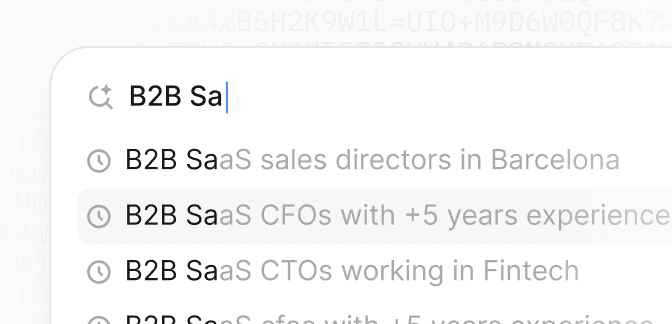

1. Enginy

O Enginy destaca-se como a plataforma definitiva de geração de leads B2B e automação de outreach com IA, concebida para todos, desde líderes de Vendas até utilizadores não técnicos. Esta ferramenta intuitiva simplifica a geração de leads ao integrar agregação de dados B2B com automação de outreach. Com o Enginy, criar listas de leads a partir das redes sociais, enriquecer dados com emails e números de telefone verificados e lançar campanhas automatizadas de outreach por email e redes sociais torna-se simples. O Enginy prioriza a facilidade de utilização e a standardização, tornando-o acessível a todos, desde Sales Managers a Recruiters, entregando resultados de forma simples e eficaz.

2. Phantom Buster

O Phantom Buster é uma poderosa ferramenta de automação de tarefas online concebida para simplificar e acelerar processos repetitivos na web. Oferece uma ampla gama de capacidades de automação, incluindo web scraping para extração de dados, automação de redes sociais, interações em massa, automação de tarefas relacionadas com vendas, ações personalizáveis, integrações e flexibilidade através de vários modelos e configurações. O Phantom Buster simplifica e acelera tarefas online, poupando tempo aos utilizadores e aumentando a eficácia das operações online.

3. Captain Data

O Captain Data assegura um lugar no top 3, oferecendo uma grande variedade de cenários de extração de dados e automação. Facilita a extração de dados estruturados de mais de 30 fontes, incluindo redes sociais, Google e TrustPilot. Para além de ser uma ferramenta de web scraping, o Captain Data funciona como uma suíte abrangente de automação de dados, com mais de 400 fluxos de trabalho prontos a usar. Permite às equipas de vendas e marketing trabalhar de forma mais eficiente e eficaz, sem necessidade de programação. O Captain Data é uma solução ideal para equipas de Sales Ops e Growth que procuram escalar a geração de leads e impulsionar o crescimento da empresa.

4. Octoparse

O Octoparse é um serviço versátil de extração de dados adequado para geração de leads, monitorização de preços, marketing e investigação. Destaca-se pela sua facilidade de utilização, permitindo aos utilizadores extrair dados com facilidade através de uma abordagem point-and-click, sem necessidade de conhecimentos de programação. O crawler web baseado na cloud do Octoparse pode fazer scraping de vários websites, gerando tabelas de dados estruturados. Os utilizadores podem agendar e automatizar tarefas 24/7 através de fluxos de trabalho drag-and-drop. O Octoparse extrai texto, links, URLs de imagens e muito mais da web. Oferece um plano gratuito com até 10 crawlers, com o plano standard a começar em 75$/mês.

5. Diffbot

O Diffbot destina-se a empresas de grande porte com requisitos específicos de rastreamento de dados e screen scraping. Fornece um conjunto de funcionalidades para converter dados web não estruturados em bases de dados estruturadas e contextuais. O Diffbot destaca-se na extração de artigos, páginas de notícias, páginas de produtos e fóruns. Os utilizadores valorizam as APIs do Diffbot e os recursos técnicos avançados, particularmente para a extração de dados de redes sociais. No entanto, alguns utilizadores consideram que existe uma curva de aprendizagem, exigindo familiaridade com a sua linguagem de consulta. O Diffbot oferece um teste gratuito de duas semanas com acesso total à API, com preços a partir de 299$.

6. Brightdata

A Brightdata serve empresas de diversos setores, incluindo finanças, retalho, viagens e cibersegurança, que procuram tirar partido dos dados da web em seu benefício. O Brightdata Data Collector facilita a recolha de dados web em escala, sem necessidade de configuração de infraestrutura. Os casos de utilização vão da investigação de mercado e SEO ao rastreamento de motores de pesquisa e monitorização do mercado bolsista. A Brightdata fornece dados web estruturados compatíveis com várias aplicações. Os preços do Data Collector começam nos 350$ por 100.000 carregamentos de página.

7. Web Scraper (Chrome Extension)

A extensão Web Scraper Chrome é uma poderosa ferramenta gratuita de extração de dados que pode rastrear e analisar dados da web. Apesar de ser uma ferramenta gratuita, oferece capacidades substanciais. Os utilizadores podem extrair dados de websites dinâmicos, incluindo categorias, subcategorias, páginas de produtos e paginação. O Web Scraper apresenta uma interface point-and-click e oferece inúmeros exemplos para ajudar os utilizadores a começar. Permite descarregar rapidamente tabelas e listas em formato CSV sem necessidade de programação. Embora a extensão do navegador seja gratuita, existem planos pagos para quem procura automação, opções adicionais de exportação, proxy, parser e API. Os preços começam em 50$ por mês para estas funcionalidades.

8. Simplescraper

O Simplescraper faz jus ao nome ao oferecer web scraping simplificado. Esta ferramenta é completamente gratuita e pode ser descarregada instantaneamente. Permite fazer scraping localmente, executar receitas na cloud ou criar uma API. Cada website extraído torna-se uma API, permitindo aos utilizadores obter dados atualizados repetidamente. O Simplescraper permite extrair dados de milhares de páginas web com um único clique, exportar para o Google Sheets e extrair dados de links com deep scraping. Notavelmente poderosa para uma ferramenta gratuita!

9. Scraper API

A Scraper API adapta-se a empresas de todas as dimensões, desde startups a grandes corporações. Esta solução de extração de dados gere proxies, browsers e CAPTCHAs, permitindo aos utilizadores fazer scraping de qualquer página web com uma chamada de API simples. Os utilizadores submetem o URL de onde pretendem extrair dados, e a Scraper API devolve o conteúdo HTML. Oferece geotargeting, contorno de anti-bot, renderização JavaScript, suporte dedicado e proxies residenciais, tornando-a uma ferramenta de scraping poderosa. A Scraper API disponibiliza um teste gratuito com 5.000 créditos de API, com planos pagos a partir de 29$ para 250.000 créditos de API.

10. ScrapingBee

O ScrapingBee revela-se uma ferramenta robusta de extração de dados, adequada para várias tarefas de web scraping. As equipas de vendas utilizam-na para geração de leads, extração de informações de contacto e recolha de dados de redes sociais. Os profissionais de marketing recorrem ao ScrapingBee para growth hacking e atividades de SEO, incluindo monitorização de palavras-chave e verificação de backlinks, graças ao seu amplo conjunto de proxies. O ScrapingBee gere instâncias headless usando a versão mais recente do Chrome, oferece renderização JavaScript e faz rotação de proxies para minimizar o risco de bloqueio por medidas anti-scraping. A ferramenta oferece um teste gratuito com 1.000 chamadas de API, sem necessidade de cartão de crédito, e um plano inicial a partir de 49$ por mês para 100.000 créditos de API.

Atualizações de janeiro de 2026 na extração de dados

A regulação está a empurrar a extração para um acesso auditável

Em janeiro de 2026, a extração de dados na Europa está a ser moldada por regras que recompensam o acesso a dados com permissão e rastreável em vez de scraping descontrolado. O EU Data Act está em vigor desde setembro de 2025 e, embora não seja uma “lei do scraping”, reforça uma mudança mais ampla: espera-se que as empresas disponibilizem formas estruturadas de aceder e partilhar dados gerados por produtos conectados e serviços relacionados.

Para fluxos de trabalho B2B, isto reduz o apelo a longo prazo de pipelines de scraping frágeis e aumenta o valor de stacks de extração que se possam ligar a APIs, exportações autorizadas e partilha de dados compatível com a governação.

Em paralelo, o EU AI Act já está a afetar a forma como os fornecedores constroem funcionalidades de extração com IA. Mesmo antes da plena aplicabilidade em agosto de 2026, o mercado está a mover-se para expectativas mais fortes em torno de registo, transparência e controlos quando a IA é usada para enriquecimento, classificação ou sinais de intenção.

O resultado é prático: mais foco em trilhas de auditoria, explicabilidade, políticas de retenção e controlos do utilizador dentro dos produtos de extração.

As defesas anti-bot tornaram-se uma restrição central do produto

2025 foi um ponto de viragem na aplicação de medidas anti-scraping, e o impacto é totalmente visível em 2026. As defesas modernas dependem menos de simples bloqueios de IP e mais de deteção comportamental, fingerprinting e desafios adaptativos.

Fornecedores como a Cloudflare destacaram publicamente novas abordagens para abrandar ou desviar bots, particularmente os associados a rastreamento automatizado em grande escala. Isso altera os critérios de compra: as ferramentas de extração já não impressionam porque “conseguem fazer scraping de tudo”; são valiosas quando entregam throughput previsível, taxas de sucesso estáveis e tratamento claro de falhas.

Para equipas que executam workloads reais, a nova base é a maturidade operacional: retries inteligentes, deteção de bloqueios, estratégias de renderização para páginas pesadas em JavaScript e observabilidade que mostra onde e por que razão a extração falha. Por outras palavras, as melhores configurações de extração em 2026 parecem menos scrapers pontuais e mais pipelines de dados fiáveis.

Fontes first-party e baseadas em consentimento estão a ganhar prioridade

A privacidade e a incerteza em torno do tracking continuam a remodelar as estratégias de aquisição. Com a pressão contínua sobre o tracking entre sites e uma clara tendência para padrões por defeito que preservam a privacidade, muitas organizações estão a apostar mais em dados first-party e com consentimento.

Isto não elimina a extração web, mas altera o centro de gravidade: mais valor passa agora por extrair e estruturar dados a partir de pontos de contacto próprios, como formulários, portais, analytics de produto, registos de eventos, marketplaces e interações com clientes, e depois enriquecê-los de forma controlada.

Isto também afeta o tooling. A extração é cada vez mais acompanhada por validação de dados e resolução de identidade, para que a saída possa ser ativada rapidamente sem poluir CRMs ou análises downstream.

A métrica de sucesso passou do volume para registos utilizáveis

Em 2026, as equipas avançadas preocupam-se menos com o custo por mil linhas e mais com o custo por registo utilizável e enriquecido. Isso significa que desduplicação, verificação, controlos de frescura e atualização programada não são “extras”, são requisitos centrais.

Se um dataset não puder ser ativado rapidamente num CRM, numa camada de analytics ou num fluxo de outreach, é tratado como desperdício operacional.

A conclusão prática é simples: os programas de extração mais fortes agora otimizam para durabilidade, conformidade e velocidade de ativação. A extração de dados já não é apenas uma capacidade técnica. É uma camada estratégica que liga conformidade, fiabilidade da infraestrutura e operações de receita de uma forma que pode escalar sem avarias constantes.

Atualizações de 2025 nas Ferramentas de Extração de Dados

Em 2025, as ferramentas de extração de dados evoluíram drasticamente graças à integração de IA generativa, OCR avançado e visão computacional. O foco já não está apenas em ler PDFs ou websites, mas em compreender documentos dinâmicos e transformá-los em dados estruturados prontos para integração com sistemas ERP, CRM ou data warehouse. A tendência é clara: maior precisão, menos templates e implementação mais rápida.

1. Do OCR Tradicional ao Processamento Inteligente de Documentos (IDP)

As novas plataformas de Intelligent Document Processing utilizam modelos de IA pré-treinados para extrair dados de faturas, contratos e guias de remessa, adaptando-se automaticamente a alterações de layout.

Atualmente, atingem taxas de precisão acima de 95%, em comparação com 60–80% no OCR tradicional, e integram-se com fluxos de trabalho RPA para automatizar todo o processo de extração e validação.

2. Extração Web com IA e Sem Código

As modernas ferramentas de web scraping permitem agora aos utilizadores extrair dados sem escrever código. Funcionalidades como rotação automática de proxies, resolução de CAPTCHA e limpeza de HTML simplificam a recolha de dados para equipas de marketing, analytics e e-commerce.

Isto torna a extração de dados mais acessível e eficiente do que nunca.

3. APIs Prontas para Integração Sem Fricção

A maioria das plataformas de extração de dados inclui agora APIs nativas que enviam informação estruturada diretamente para sistemas-alvo.

Soluções como Klippa, Procys e Airbyte convertem conteúdo não estruturado em dados prontos a usar em minutos, reduzindo o tempo de configuração manual e a complexidade.

4. Segurança e Conformidade Reforçadas

À medida que aumenta a extração de dados sensíveis, os fornecedores estão a priorizar a segurança dos dados e a conformidade regulatória, cumprindo normas como GDPR, ISO 27001 e HIPAA — uma área de particular importância para relatórios financeiros e setores regulados.

Isto permite que a extração automatizada se expanda para finanças, saúde e seguros, onde a proteção de dados é crítica.

5. Proteções Anti-Scraping Mais Fortes

Os websites estão a introduzir tecnologias avançadas anti-scraping para combater a recolha não autorizada de dados.

Plataformas como Cloudflare e Reddit implementaram sistemas de deteção e bloqueio, levando as ferramentas profissionais a adicionar deteção de bloqueios e routing adaptativo para manter um desempenho de scraping fiável.

6. Entrada de Grandes Players do Mercado

Grandes players como a Box lançaram as suas próprias ferramentas de extração com IA, como o Box Extract, que consegue processar texto, imagens e até áudio.

Isto mostra que a extração de dados se tornou uma capacidade central nos ecossistemas de automação empresarial e gestão de conteúdos.

No geral, a extração de dados em 2025 é mais inteligente, mais rápida e mais em conformidade — uma função estratégica que ajuda as empresas a simplificar operações e a tomar decisões baseadas em dados com confiança.

O Futuro da Extração de Dados em 2025: Da Automação à Inteligência

A Extração com IA Torna-se Sensível ao Contexto

A era do web scraping simples terminou. Em 2025, as mais avançadas ferramentas de extração de dados evoluíram de capturar informação bruta para compreender o seu contexto e relevância.

Plataformas como Enginy, Diffbot e Captain Data combinam agora modelos de IA, processamento de linguagem natural (NLP) e aprendizagem automática para interpretar o significado por trás dos dados que recolhem.

Em vez de simplesmente extrair nomes de empresas ou emails, estas ferramentas detetam sinais de intenção, alterações organizacionais e gatilhos em tempo real, como rondas de financiamento, mudanças de liderança ou tendências de contratação.

Esta perceção contextual transforma listas estáticas em datasets inteligentes e priorizados que as equipas de vendas e marketing podem agir de imediato.

Por exemplo, se um extrator com IA identificar uma empresa SaaS a contratar representantes de outbound e que recentemente levantou uma ronda Series A, marca automaticamente o registo como uma oportunidade de alta conversão.

Essa combinação de enriquecimento de dados e analítica preditiva permite decisões mais rápidas e outreach mais preciso.

O novo padrão não é a quantidade de dados que consegue recolher, mas sim com que inteligência os consegue usar.

Integrar a Extração na Stack de Dados B2B

Um dos maiores desafios nas operações de dados é garantir que os dados extraídos fluem sem problemas entre sistemas.

As organizações B2B com melhor desempenho tratam agora a extração de dados como uma camada central da sua infraestrutura de automação, e não como uma atividade isolada.

A stack de dados moderna tem três componentes essenciais:

Camada de Captura: Ferramentas de extração como Enginy ou Brightdata recolhem dados estruturados e semi-estruturados de fontes públicas — websites de empresas, LinkedIn, diretórios e sites de avaliações.

Camada de Enriquecimento: Esses dados brutos são limpos, validados e aumentados com insights adicionais — como senioridade da função, dimensão da empresa e sinais de intenção — antes de entrarem no CRM.

Camada de Ativação: Os dados enriquecidos são sincronizados automaticamente com ferramentas de outreach, permitindo campanhas multicanal por email, LinkedIn e outros canais.

Quando estas camadas funcionam em conjunto, as equipas conseguem um fluxo contínuo de informação verificada e em tempo real.

Este processo, frequentemente chamado orquestração de dados em tempo real, garante que o seu CRM e os dashboards de analytics estão sempre corretos e acionáveis.

O benefício da integração é claro: dados mais limpos, mensagens mais relevantes e menos tempo perdido em atualizações manuais.

Conformidade e Recolha Ética de Dados

À medida que a automação se expande, também aumenta o escrutínio. O futuro da extração de dados depende igualmente de transparência e conformidade com a privacidade.

Os fornecedores destacam agora o alinhamento com o GDPR, a certificação ISO 27001 e o abastecimento responsável.

Plataformas como o Enginy integraram a conformidade no seu design — armazenando apenas dados publicamente disponíveis, anonimizando identificadores pessoais e mantendo trilhos de auditoria para cada registo.

A extração ética não evita apenas riscos; também constrói confiança. Em 2025, os clientes esperam responsabilização na forma como os dados são recolhidos e usados, e as empresas que priorizam isto ganham uma vantagem competitiva de longo prazo.

Maximizar o ROI e a Escalabilidade na Extração de Dados

Calcular o Verdadeiro Retorno da Automação de Dados

Métricas tradicionais como “custo por 1.000 registos” já não são suficientes.

O verdadeiro indicador de desempenho para fluxos de trabalho modernos de extração é o Custo por Registo Enriquecido (CER) — o preço pago por dados verificados e utilizáveis que realmente convertem.

Medido desta forma, as ferramentas de extração orientadas por IA superam consistentemente scrapers manuais ou de baixo custo. Embora possam custar ligeiramente mais à partida, a sua verificação, desduplicação e enriquecimento integrados reduzem drasticamente o esforço desperdiçado.

A conclusão: a opção mais barata raramente oferece o melhor valor. Quando a automação é combinada com enriquecimento por IA, precisão, velocidade e ROI aumentam em simultâneo.

Construir um Fluxo de Trabalho de Dados Automatizado e Escalável

Escalar a extração de dados não significa adicionar mais ferramentas — significa conceber um ecossistema conectado. Eis uma estrutura prática de três passos usada por equipas B2B de rápido crescimento:

Auditar e Preparar: Rever o seu CRM e remover duplicados ou registos desatualizados. Defina o que significa “dados de alta qualidade” para a sua equipa — por exemplo, email verificado, função atual, dimensão da empresa.

Automatizar a Recolha: Configure extratores orientados por IA como o Enginy ou o Captain Data para recolher continuamente novas informações de fontes online relevantes. Configure fluxos de trabalho para atualizar campos-chave (como cargos de contacto ou firmographics) a cada 30–45 dias.

Ativar e Medir: Ligue os seus dados enriquecidos a plataformas de automação como HubSpot, Apollo ou LinkedIn Sales Navigator. Acompanhe taxas de reunião, tempo de resposta e taxas de conversão por 1.000 leads enriquecidos.

Ao fim de 60 dias, as equipas que seguem esta estrutura normalmente reduzem a pesquisa manual em 70% e observam um aumento de 2–3× na eficiência de outbound.

Tendências Futuras e o Que Vem a Seguir

Olhando em frente, a extração de dados continuará a fundir-se com a IA autónoma de vendas.

Agentes alimentados por ferramentas como o Enginy AI irão processar automaticamente os dados extraídos, iniciar conversas e gerir follow-ups — fechando o ciclo de dados para diálogo.

Também veremos inovações como:

APIs de enriquecimento em tempo real que transmitem contactos verificados para CRMs instantaneamente.

Crawlers autónomos que descobrem novas fontes sem intervenção humana.

Modelos preditivos de extração que antecipam quais leads têm maior probabilidade de converter com base em padrões de engagement anteriores.

A próxima etapa é clara: a extração de dados torna-se extração de inteligência — um processo contínuo que alimenta a tomada de decisão, e não apenas bases de dados.

Em conclusão, as empresas que procuram tirar partido do poder dos dados dispõem de uma vasta gama de ferramentas de extração de dados. Quer seja um profissional de dados experiente ou alguém novo no mundo da extração de dados, estas ferramentas oferecem opções diversas para responder às suas necessidades e objetivos específicos. Explore as funcionalidades e capacidades de cada ferramenta para determinar a melhor opção para os requisitos de extração de dados da sua empresa em 2025.