I migliori strumenti di estrazione dati del 2026: più intelligenti, più veloci, automatizzati

Andrea Lopez

Condividi

Gli strumenti di estrazione dati nel 2026 sono diventati essenziali per le aziende che dipendono da informazioni accurate e in tempo reale per alimentare la crescita. In un mondo in cui i dati sono il motore di tutto, dalla generazione di lead all'analisi competitiva e alla previsione dei trend di mercato, questi strumenti rendono possibile raccogliere, pulire e strutturare automaticamente i dati web su larga scala.

La sfida per la maggior parte delle aziende non è più l'accesso ai dati, ma come estrarli in modo efficiente, senza perdere tempo o rischiare problemi di conformità.

I moderni strumenti di estrazione dati risolvono questo problema combinando IA, automazione e interfacce no-code, trasformando contenuti web non strutturati in insight azionabili, pronti per essere utilizzati in CRM, dashboard o piattaforme di analisi.

In questa guida spiegheremo cosa significhi davvero estrazione dati nel 2026, perché è diventata una capacità strategica per i team B2B e enterprise e quali strumenti stanno guidando il mercato in termini di velocità, scalabilità e automazione intelligente.

Comprendere l'Estrazione dei Dati

Che cos'è l'Estrazione dei Dati?

L'estrazione dei dati è il processo di recupero di informazioni da fonti diverse per ottenere insight e prendere decisioni aziendali informate. Queste informazioni possono essere strutturate, non strutturate o parzialmente strutturate, a seconda della fonte — una pratica essenziale per le società quotate e per le organizzazioni che fanno affidamento su un accesso tempestivo e conforme ai dati di business.

Ad esempio, nelle vendite B2B, l'estrazione dei dati può comportare il recupero di informazioni sui lead dai social media per creare un elenco mirato di prospect. Tuttavia, un'eccessiva automazione o lo scraping possono talvolta attivare restrizioni dei social media, quindi comprendere i limiti delle piattaforme è essenziale prima di avviare un'estrazione dati su larga scala.

L'estrazione dei dati rappresenta la fase iniziale del processo ETL (Extract, Transform & Load). Gli strumenti ETL prendono dati grezzi da varie fonti e li preparano per l'integrazione in un altro sistema, assicurando che siano nel formato corretto per l'analisi. Un esempio di strumento che opera in modo simile all'ETL è Captain Data, che svolge attività come raccogliere dati da più fonti web, aggregare dati grezzi in informazioni strutturate e integrarli senza soluzione di continuità nel CRM o in altri strumenti.

Perché le aziende hanno bisogno dell'estrazione dei dati

Le aziende si affidano all'estrazione dei dati per diversi motivi:

Creare database di informazioni pertinenti e aggiornate.

Generare insight azionabili per le strategie di vendita e marketing.

Migliorare la qualità dei dati concentrandosi su fonti rilevanti e riducendo al minimo gli errori umani.

Ottenere una comprensione più approfondita del mercato e della concorrenza. Questo è particolarmente vero se combinato con i buying signals b2b, che aiutano i team a comprendere l'intento oltre i dataset grezzi — insight che spesso rivelano nuove opportunità di business per i team di vendita e marketing.

Come funziona l'estrazione dei dati

Se il motore di ricerca di Google offre un esempio di estrazione dei dati attraverso il crawling dei siti web e l'estrazione di informazioni per i risultati di ricerca, questo articolo si concentra principalmente sull'estrazione di dati strutturati, spesso definita “smart data”. I dati strutturati sono ben organizzati e pronti per l'analisi. Un software di automazione, come Captain Data, utilizza tecniche di web scraping per raccogliere questi smart data.

Web Scraping o Estrazione di Dati Web

Il web scraping consiste nell'estrazione di dati pubblicamente disponibili dai siti web, consentendo l'aggregazione rapida di informazioni preziose da inserire in un database. I tipi di dati che possono essere estratti includono email, numeri di telefono e indirizzi postali. Il web scraping può essere suddiviso in due tipologie: manuale e automatizzato.

Lo scraping manuale consiste nel copiare e incollare manualmente le informazioni in un database o in un foglio di calcolo, ed è adatto a task di estrazione dati su piccola scala.

Lo scraping automatizzato, invece, utilizza strumenti di estrazione dati che recuperano rapidamente grandi volumi di dati da fonti online.

Il web scraping è particolarmente prezioso per i team di vendita perché li aiuta a:

Compilare elenchi di aziende target e lead da fonti come SalesNavigator sui social media, Google Maps, Pagine Gialle e altro ancora.

Identificare i principali decision maker e le potenziali opportunità di business.

Arricchire e qualificare i lead.

Risparmiare tempo automatizzando l'inserimento manuale dei dati e migliorando l'accuratezza grazie a strumenti avanzati di data enrichment che completano i flussi di estrazione.

Introduzione agli Strumenti di Estrazione Dati

Cosa fanno gli strumenti di estrazione dati?

Gli strumenti di estrazione dati utilizzano l'automazione per recuperare dati da moduli, siti web, email e altre fonti online.Gli strumenti di estrazione dati utilizzano l'automazione per recuperare dati da moduli, siti web, email e altre fonti online, fungendo spesso da base per l'arricchimento dei dati CRM e la qualificazione dei lead.

Questi strumenti rientrano in varie categorie:

Soluzioni SaaS

Estensioni Chrome

Bot scraper/API di web scraping

Librerie open source

Proxy e dataset

I vantaggi dei software di estrazione dati

I software di estrazione dati offrono numerosi vantaggi, tra cui:

Risparmio di tempo: l'automazione riduce l'impegno manuale richiesto dai processi dati.

Maggiore efficienza: ottenere di più in meno tempo.

Facilità d'uso: gli strumenti no-code per l'estrazione dei dati semplificano la configurazione dei flussi di automazione, anche per gli utenti non tecnici.

Accuratezza: ridurre al minimo il rischio di errore umano.

Scalabilità: accedere rapidamente a grandi volumi di dati strutturati per la crescita del business, come la generazione di lead e le opportunità di vendita.

Ora, addentriamoci nei 10 migliori strumenti di estrazione dati.

I 10 Migliori Strumenti di Estrazione Dati per il 2026

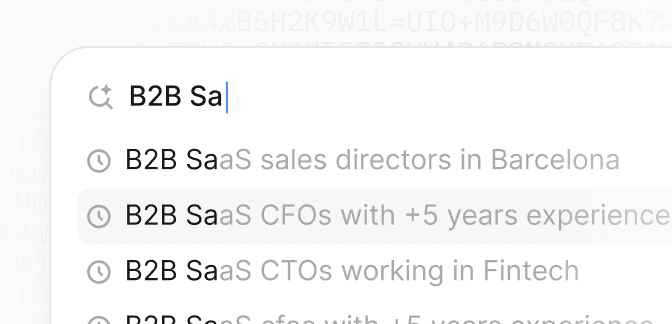

1. Enginy

Enginy si distingue come la piattaforma definitiva per la generazione di lead B2B e l'automazione outreach basata su IA, progettata per tutti, dai leader Sales agli utenti non tecnici. Questo strumento intuitivo semplifica la generazione di lead integrando l'aggregazione dei dati B2B con l'automazione dell'outreach. Con Enginy, creare liste di lead dai social media, arricchire i dati con email e numeri di telefono verificati e avviare campagne di outreach automatizzate via email e social media diventa semplice. Enginy dà priorità alla facilità d'uso e alla standardizzazione, rendendolo accessibile a tutti, dai Sales Manager ai Recruiter, e offrendo risultati in modo semplice ed efficace.

2. Phantom Buster

Phantom Buster è un potente strumento di automazione delle attività online progettato per semplificare e accelerare i processi ripetitivi sul web. Offre un'ampia gamma di funzionalità di automazione, tra cui web scraping per l'estrazione dei dati, automazione dei social media, interazioni di massa, automazione di task legati alle vendite, azioni personalizzabili, integrazioni e flessibilità grazie a diversi template e configurazioni. Phantom Buster snellisce e accelera le attività online, facendo risparmiare tempo agli utenti e migliorando l'efficacia delle operazioni online.

3. Captain Data

Captain Data si assicura un posto nella top 3, offrendo una moltitudine di scenari di estrazione dati e automazione. Facilita l'estrazione di dati strutturati da oltre 30 fonti, tra cui social media, Google e TrustPilot. Oltre a essere uno strumento di web scraping, Captain Data è una suite completa di automazione dei dati, con oltre 400 workflow pronti all'uso. Consente ai team di vendita e marketing di lavorare in modo più efficiente ed efficace senza bisogno di programmare. Captain Data è una soluzione ideale per i team Sales Ops e Growth che desiderano scalare la generazione di lead e accelerare la crescita aziendale.

4. Octoparse

Octoparse è un servizio di estrazione dati versatile, adatto a lead generation, monitoraggio dei prezzi, marketing e ricerca. Si distingue per la facilità d'uso, consentendo agli utenti di estrarre dati con semplicità tramite un approccio point-and-click, senza richiedere competenze di programmazione. Il crawler web basato su cloud di Octoparse può effettuare scraping di vari siti web, generando tabelle di dati strutturati. Gli utenti possono pianificare e automatizzare attività 24/7 utilizzando workflow drag-and-drop. Octoparse estrae testi, link, URL di immagini e altro ancora dal web. Offre un piano gratuito con fino a 10 crawler, mentre il piano standard parte da 75$/mese.

5. Diffbot

Diffbot si rivolge alle aziende enterprise con specifiche esigenze di data crawling e screen scraping. Offre una suite di funzionalità per convertire dati web non strutturati in database strutturati e contestuali. Diffbot eccelle nell'estrazione di articoli, pagine di notizie, pagine prodotto e forum. Gli utenti apprezzano le API di Diffbot e le risorse tecniche avanzate, in particolare per l'estrazione di dati dai social media. Tuttavia, alcuni utenti trovano che presenti una curva di apprendimento, richiedendo familiarità con il suo linguaggio di query. Diffbot offre una prova gratuita di due settimane con accesso completo alle API, con prezzi a partire da 299$.

6. Brightdata

Brightdata serve aziende di settori diversi, tra cui finanza, retail, viaggi e cybersecurity, che desiderano sfruttare i dati web a proprio vantaggio. Il Brightdata Data Collector facilita la raccolta di dati web su larga scala senza alcuna configurazione infrastrutturale. I casi d'uso vanno dalla ricerca di mercato e SEO al crawling dei motori di ricerca e al monitoraggio del mercato azionario. Brightdata fornisce dati web strutturati compatibili con varie applicazioni. Il prezzo del Data Collector parte da 350$ per 100.000 page load.

7. Web Scraper (Estensione Chrome)

L'estensione Chrome Web Scraper è un potente strumento gratuito di data scraping in grado di eseguire crawling e analisi dei dati web. Pur essendo gratuito, offre capacità sostanziali. Gli utenti possono estrarre dati da siti web dinamici, incluse categorie, sottocategorie, pagine prodotto e paginazione. Web Scraper dispone di un'interfaccia point-and-click e offre numerosi esempi per aiutare gli utenti a iniziare. Consente di scaricare rapidamente tabelle ed elenchi in formato CSV senza bisogno di programmare. Sebbene l'estensione del browser sia gratuita, sono disponibili piani a pagamento per chi cerca automazione, opzioni di esportazione aggiuntive, un proxy, un parser e un'API. I prezzi partono da 50$ al mese per queste funzionalità.

8. Simplescraper

Simplescraper mantiene la promessa del suo nome offrendo uno scraping web semplificato. Questo strumento è completamente gratuito e può essere scaricato all'istante. Consente agli utenti di eseguire scraping in locale, avviare ricette nel cloud o creare un'API. Ogni sito web sottoposto a scraping diventa un'API, consentendo agli utenti di recuperare dati aggiornati in modo ripetuto. Simplescraper consente di estrarre dati da migliaia di pagine web con un solo clic, esportare su Google Sheets ed estrarre dati da link con deep scraping. Straordinariamente potente per uno strumento gratuito!

9. Scraper API

Scraper API è adatto ad aziende di tutte le dimensioni, dalle startup alle grandi imprese. Questa soluzione di estrazione dati gestisce proxy, browser e CAPTCHA, consentendo agli utenti di eseguire lo scraping di qualsiasi pagina web con una semplice chiamata API. Gli utenti inviano l'URL da cui desiderano estrarre i dati e Scraper API restituisce il contenuto HTML. Offre geotargeting, bypass anti-bot, rendering JavaScript, supporto dedicato e proxy residenziali, rendendolo uno strumento di scraping molto potente. Scraper API offre una prova gratuita con 5.000 crediti API, con piani a pagamento a partire da 29$ per 250.000 crediti API.

10. ScrapingBee

ScrapingBee si dimostra uno strumento di estrazione dati robusto, adatto a vari task di web scraping. I team di vendita lo utilizzano per la generazione di lead, l'estrazione di informazioni di contatto e il recupero di dati dai social media. I marketer si affidano a ScrapingBee per attività di growth hacking e SEO, tra cui il monitoraggio delle keyword e il controllo dei backlink, grazie al suo ampio pool di proxy. ScrapingBee gestisce istanze headless utilizzando l'ultima versione di Chrome, offre il rendering JavaScript e ruota i proxy per ridurre al minimo il rischio di blocchi da parte delle misure anti-scraping. Lo strumento offre una prova gratuita con 1.000 chiamate API, senza bisogno di carta di credito, e un piano entry-level a partire da 49$ al mese per 100.000 crediti API.

Aggiornamenti di gennaio 2026 nell'estrazione dei dati

La normativa sta spingendo l'estrazione verso accessi verificabili

A gennaio 2026, l'estrazione dei dati in Europa è influenzata da norme che premiano l'accesso ai dati autorizzato e tracciabile rispetto allo scraping non controllato. L'EU Data Act è applicabile da settembre 2025 e, pur non essendo una “legge sullo scraping”, rafforza un cambiamento più ampio: ci si aspetta che le aziende abilitino modalità strutturate per accedere e condividere i dati generati da prodotti connessi e servizi correlati.

Per i flussi di lavoro B2B, questo riduce l'attrattiva a lungo termine delle pipeline di scraping fragili e aumenta il valore di stack di estrazione che possono integrarsi con API, esportazioni autorizzate e condivisione dei dati orientata alla governance.

In parallelo, l'EU AI Act sta già influenzando il modo in cui i vendor costruiscono funzionalità di estrazione basate su IA. Anche prima della piena applicabilità nell'agosto 2026, il mercato si sta orientando verso aspettative più elevate in materia di logging, trasparenza e controlli quando l'IA viene utilizzata per arricchimento, classificazione o segnali di intent.

Il risultato è concreto: maggiore attenzione a audit trail, spiegabilità, policy di conservazione e controlli utente all'interno dei prodotti di estrazione.

Le difese anti-bot sono diventate un vincolo di prodotto centrale

Il 2025 è stato un punto di svolta nell'applicazione delle difese anti-scraping e l'impatto è pienamente visibile nel 2026. Le difese moderne si basano meno sui semplici blocchi IP e più su rilevamento comportamentale, fingerprinting e challenge adattive.

Provider come Cloudflare hanno evidenziato pubblicamente nuovi approcci per rallentare o depistare i bot, in particolare quelli associati al crawling automatizzato su larga scala. Questo cambia i criteri di acquisto: gli strumenti di estrazione non sono più impressionanti perché “possono fare scraping di tutto”, ma sono preziosi quando garantiscono throughput prevedibile, tassi di successo stabili e gestione chiara degli errori.

Per i team che eseguono workload reali, il nuovo standard di base è la maturità operativa: smart retry, rilevamento dei blocchi, strategie di rendering per pagine pesanti in JavaScript e osservabilità che mostri dove e perché l'estrazione si interrompe. In altre parole, i migliori setup di estrazione nel 2026 assomigliano meno a scraper one-off e più a pipeline di dati affidabili.

Le fonti first-party e basate sul consenso stanno acquisendo priorità

L'incertezza su privacy e tracking continua a ridefinire le strategie di acquisizione. Con la pressione costante sul tracciamento cross-site e una chiara spinta verso impostazioni predefinite che preservino la privacy, molte organizzazioni stanno puntando sempre di più su dati first-party e consensati.

Questo non elimina l'estrazione web, ma ne sposta il baricentro: oggi il valore deriva sempre più dall'estrazione e dalla strutturazione di dati da touchpoint di proprietà come form, portali, analytics di prodotto, registrazioni a eventi, marketplace e interazioni con i clienti, per poi arricchirli in modo controllato.

Questo influisce anche sugli strumenti. L'estrazione viene sempre più affiancata da validazione dei dati e identity resolution in modo che l'output possa essere attivato rapidamente senza contaminare i CRM o le analisi downstream.

Il metrica di successo è passata dal volume ai record utilizzabili

Nel 2026, i team avanzati si preoccupano meno del costo per mille righe e più del costo per record utilizzabile e arricchito. Ciò significa che deduplicazione, verifica, controlli di freschezza e refresh pianificato non sono “nice-to-have”, ma requisiti fondamentali.

Se un dataset non può essere attivato rapidamente in un CRM, in un layer di analytics o in un workflow di outreach, viene considerato spreco operativo.

Il takeaway pratico è semplice: i programmi di estrazione più solidi ottimizzano ora per durabilità, conformità e velocità di attivazione. L'estrazione dei dati non è più solo una capacità tecnica. È un livello strategico che collega conformità, affidabilità dell'infrastruttura e revenue operations in un modo che può scalare senza continui guasti.

Aggiornamenti 2025 negli Strumenti di Estrazione Dati

Nel 2025, gli strumenti di estrazione dati si sono evoluti in modo significativo grazie all'integrazione di IA generativa, OCR avanzato e computer vision. L'attenzione non è più solo sulla lettura di PDF o siti web, ma sulla comprensione di documenti dinamici e sulla loro trasformazione in dati strutturati pronti per l'integrazione con sistemi ERP, CRM o data warehouse. La tendenza è chiara: maggiore accuratezza, meno template e deployment più rapido.

1. Dall'OCR tradizionale all'Intelligent Document Processing (IDP)

Le nuove piattaforme di Intelligent Document Processing utilizzano modelli IA pre-addestrati per estrarre dati da fatture, contratti e DDT, adattandosi automaticamente ai cambiamenti di layout.

Oggi raggiungono tassi di accuratezza superiori al 95%, rispetto al 60–80% dell'OCR tradizionale, e si integrano con i workflow RPA per automatizzare l'intero processo di estrazione e validazione.

2. Estrazione web no-code basata su IA

I moderni strumenti di web scraping consentono oggi agli utenti di estrarre dati senza scrivere codice. Funzionalità come rotazione automatica dei proxy, risoluzione dei CAPTCHA e pulizia dell'HTML semplificano la raccolta dati per i team di marketing, analytics ed e-commerce.

Questo rende l'estrazione dei dati più accessibile ed efficiente che mai.

3. API pronte per un'integrazione senza attriti

La maggior parte delle piattaforme di estrazione dati include ora API native che inviano informazioni strutturate direttamente ai sistemi target.

Soluzioni come Klippa, Procys e Airbyte convertono contenuti non strutturati in dati pronti all'uso in pochi minuti, riducendo tempi e complessità di configurazione manuale.

4. Sicurezza e conformità rafforzate

Con l'aumento dell'estrazione di dati sensibili, i vendor stanno dando priorità alla sicurezza dei dati e alla conformità normativa, rispettando standard come GDPR, ISO 27001 e HIPAA — un'area di particolare importanza per i bilanci finanziari e i settori regolamentati.

Ciò consente all'estrazione automatizzata di espandersi in finanza, healthcare e assicurazioni, dove la protezione dei dati è fondamentale.

5. Protezioni anti-scraping più solide

I siti web stanno introducendo tecnologie anti-scraping avanzate per contrastare la raccolta dati non autorizzata.

Piattaforme come Cloudflare e Reddit hanno implementato sistemi di rilevamento e blocco, spingendo gli strumenti professionali ad aggiungere block detection e routing adattivo per mantenere prestazioni di scraping affidabili.

6. Entrata di grandi player di mercato

Grandi player come Box hanno lanciato i propri strumenti di estrazione basati su IA, come Box Extract, in grado di elaborare testo, immagini e persino audio.

Questo dimostra che l'estrazione dei dati è diventata una capacità centrale negli ecosistemi di automazione enterprise e content management.

Nel complesso, l'estrazione dei dati nel 2025 è più intelligente, più veloce e più conforme — una funzione strategica che aiuta le aziende a snellire le operazioni e a prendere decisioni basate sui dati con maggiore fiducia.

Il futuro dell'estrazione dei dati nel 2025: dall'automazione all'intelligenza

L'estrazione basata su IA diventa contestuale

L'era del semplice web scraping è finita. Nel 2025, gli strumenti di estrazione dati più avanzati si sono evoluti dalla raccolta di informazioni grezze alla comprensione del loro contesto e della loro rilevanza.

Piattaforme come Enginy, Diffbot e Captain Data combinano ora modelli IA, natural language processing (NLP) e machine learning per interpretare il significato dei dati raccolti.

Anziché limitarsi a estrarre nomi aziendali o email, questi strumenti rilevano segnali di intent, cambiamenti organizzativi e trigger in tempo reale come round di funding, cambiamenti nella leadership o trend di assunzione.

Questa consapevolezza contestuale trasforma liste statiche in dataset intelligenti e prioritizzati che i team di vendita e marketing possono attivare immediatamente.

Ad esempio, se un extractor basato su IA identifica un'azienda SaaS che sta assumendo outbound rep e ha recentemente raccolto un round di Serie A, etichetta automaticamente il record come un'opportunità ad alta conversione.

Questa combinazione di data enrichment e analisi predittiva consente decisioni più rapide e un outreach più preciso.

Il nuovo benchmark non è quanti dati si possano raccogliere, ma quanto intelligentemente si riesca a utilizzarli.

Integrare l'estrazione nello stack dati B2B

Una delle sfide principali nelle operations dei dati è garantire che i dati estratti fluiscano senza attriti tra i sistemi.

Le organizzazioni B2B più performanti oggi considerano l'estrazione dei dati come un layer fondamentale della propria infrastruttura di automazione, non come un'attività isolata.

Lo stack dati moderno ha tre componenti essenziali:

Layer di acquisizione: strumenti di estrazione come Enginy o Brightdata raccolgono dati strutturati e semi-strutturati da fonti pubbliche — siti aziendali, LinkedIn, directory e siti di recensioni.

Layer di arricchimento: quei dati grezzi vengono puliti, validati e arricchiti con ulteriori insight — come anzianità del ruolo, dimensione aziendale e segnali di intent — prima di entrare nel CRM.

Layer di attivazione: i dati arricchiti vengono sincronizzati automaticamente con gli strumenti di outreach, abilitando campagne multicanale su email, LinkedIn e altri canali.

Quando questi layer lavorano insieme, i team ottengono un flusso continuo di informazioni verificate e in tempo reale.

Questo processo, spesso definito live data orchestration, garantisce che il CRM e le dashboard di analytics siano sempre accurati e azionabili.

Il beneficio dell'integrazione è chiaro: dati più puliti, messaggi più pertinenti e meno tempo sprecato in aggiornamenti manuali.

Conformità e raccolta dati etica

Con l'espansione dell'automazione, aumenta anche il livello di scrutinio. Il futuro dell'estrazione dei dati dipende anche da trasparenza e conformità alla privacy.

I vendor ora enfatizzano l'allineamento al GDPR, la certificazione ISO 27001 e il responsible sourcing.

Piattaforme come Enginy hanno integrato la conformità nel proprio design — memorizzando solo dati pubblicamente disponibili, anonimizzando gli identificatori personali e mantenendo audit trail per ogni record.

L'estrazione etica non si limita a evitare i rischi; costruisce fiducia. Nel 2025, i clienti si aspettano accountability nel modo in cui i dati vengono raccolti e utilizzati, e le aziende che danno priorità a questo aspetto ottengono un vantaggio competitivo di lungo periodo.

Massimizzare ROI e scalabilità nell'estrazione dei dati

Calcolare il vero ritorno sull'automazione dei dati

Le metriche tradizionali come il “costo per 1.000 record” non sono più sufficienti.

Il vero indicatore di performance per i flussi di estrazione moderni è il Cost per Enriched Record (CER) — il prezzo pagato per dati verificati e utilizzabili che convertono davvero.

Misurati in questo modo, gli strumenti di estrazione basati su IA superano costantemente gli scraper manuali o a basso costo. Anche se possono costare leggermente di più all'inizio, la loro verifica, deduplicazione e arricchimento integrati riducono drasticamente gli sprechi.

La conclusione: l'opzione più economica raramente offre il miglior valore. Quando l'automazione è combinata con AI enrichment, accuratezza, velocità e ROI aumentano contemporaneamente.

Costruire un workflow dati automatizzato e scalabile

Scalare l'estrazione dei dati non significa aggiungere più strumenti, ma progettare un ecosistema connesso. Ecco un framework pratico in tre passaggi utilizzato dai team B2B in rapida crescita:

Audit e preparazione: rivedi il CRM e rimuovi i record duplicati o obsoleti. Definisci cosa significa “dati di alta qualità” per il tuo team — ad esempio email verificata, ruolo attuale, dimensione aziendale.

Automatizzare la raccolta: imposta extractor basati su IA come Enginy o Captain Data per recuperare continuamente nuove informazioni da fonti online rilevanti. Configura workflow per aggiornare i campi chiave (come titoli di contatto o firmografica) ogni 30–45 giorni.

Attivare e misurare: collega i dati arricchiti con piattaforme di automazione come HubSpot, Apollo o LinkedIn Sales Navigator. Traccia meeting rate, tempo di risposta e conversion ratio per 1.000 lead arricchiti.

Entro 60 giorni, i team che seguono questa struttura in genere riducono la ricerca manuale del 70% e registrano un aumento di 2–3× dell'efficienza outbound.

Trend futuri e cosa ci aspetta dopo

Guardando avanti, l'estrazione dei dati continuerà a fondersi con l'autonomous sales AI.

Gli agenti alimentati da strumenti come Enginy AI elaboreranno automaticamente i dati estratti, avvieranno conversazioni e gestiranno i follow-up — completando il ciclo da dati a dialogo.

Vedremo anche innovazioni come:

API di arricchimento in tempo reale che trasmettono istantaneamente contatti verificati nei CRM.

Crawler autonomi che scoprono nuove fonti senza input umano.

Modelli di estrazione predittiva che prevedono quali lead hanno la probabilità maggiore di convertire in base ai modelli di engagement passati.

La prossima fase è chiara: l'estrazione dei dati diventa estrazione di intelligence — un processo continuo che alimenta il decision-making, non solo i database.

In conclusione, le aziende che vogliono sfruttare la potenza dei dati hanno a disposizione un'ampia gamma di strumenti di estrazione dati. Che tu sia un professionista esperto di dati o alle prime armi nel mondo dell'estrazione dei dati, questi strumenti offrono opzioni diversificate per soddisfare esigenze e obiettivi specifici. Esplora le funzionalità e le capacità di ciascuno strumento per determinare quello più adatto ai requisiti di estrazione dati della tua azienda nel 2025.