10 stratégies essentielles de tests A/B pour les e-mails de prospection en 2026

Andrea Lopez

Partager

Voici les meilleures stratégies de test A/B des e-mails de prospection pour améliorer la conversion en 2026 :

Définissez le bon objectif (arrêtez d’utiliser les ouvertures comme métrique principale)

Testez l’offre et l’angle avant l’objet du message

Optimisez la première phrase (les 150 premiers caractères)

Expérimentez avec différents CTA (appels à l’action)

Trouvez la longueur idéale pour votre audience

Concevez des expériences qui isolent la véritable causalité

Calculez la taille d’échantillon avant de commencer

Évitez d’arrêter le test quand il semble gagnant

Surveillez la délivrabilité pendant le test

Mesurez les réponses positives de manière opérationnelle

Le test A/B dans les e-mails de prospection en 2026 ne consiste plus à ajuster l’objet et à courir après les taux d’ouverture.

Entre les changements de confidentialité (qui biaisent les ouvertures), les filtres anti-spam plus stricts et la réalité de la prospection multicanale, une vraie optimisation signifie suivre des résultats significatifs : réponses positives, rendez-vous pris et conversion dans le pipeline, sans nuire à la délivrabilité.

La différence entre un test qui génère de la croissance et un test qui vous induit en erreur repose généralement sur les fondamentaux : une hypothèse claire, une seule variable principale par expérience, une vraie randomisation et des garde-fous non négociables (rebonds, plaintes pour spam, désinscriptions, placement en boîte de réception).

Sans cela, votre « gagnant » peut simplement être la version qui arrive plus souvent dans la boîte de réception, et non celle qui persuade mieux.

Dans cet article, vous trouverez 10 stratégies essentielles pour mener correctement des tests A/B d’e-mails de prospection : privilégier l’offre et l’angle plutôt que les ajustements cosmétiques, optimiser les 150 premiers caractères, adapter les CTA au niveau de conscience du problème, calculer la taille d’échantillon, définir des critères d’arrêt et, surtout, apprendre par segment afin que vos enseignements soient réutilisables et pas seulement du bruit.

10 stratégies essentielles de test A/B pour les e-mails de prospection afin d’améliorer la conversion en 2026

1. Définissez le bon objectif (oubliez les ouvertures comme métrique principale)

Le taux d’ouverture est un signal faible et de moins en moins fiable. La protection de la confidentialité d’Apple Mail précharge le contenu, peut gonfler les ouvertures et masque les vraies données de localisation et deوقيت. Optimiser uniquement les ouvertures conduit à de fausses conclusions.

Meilleure hiérarchie des métriques :

KPI principal : taux de réponse positive ou taux de prise de rendez-vous

Secondaires : réponses totales, CTR si vous utilisez des liens, taux de conversion en démo

Garde-fous : taux de rebond, plaintes pour spam, désinscriptions, délivrance/placement en boîte de réception

Gmail recommande de maintenir le taux de spam en dessous de 0,10 % et d’éviter d’atteindre 0,30 % ou plus. Dans Outlook, le taux de plaintes doit rester inférieur à 0,3 % selon SNDS.

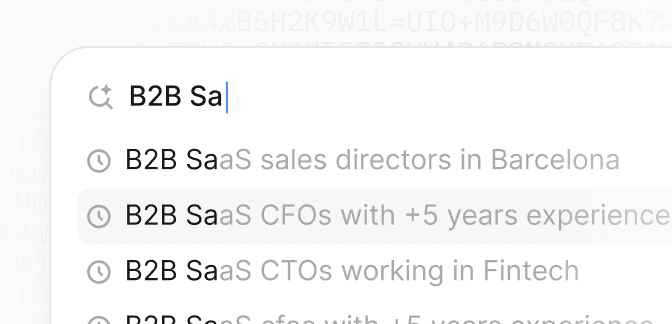

2. Testez l’offre et l’angle avant l’objet

La première variable à tester est celle qui a le plus grand impact sur la réponse : votre proposition de valeur.

Variables d’offre à fort impact :

Point de douleur principal ou déclencheur (coût, risque, temps, revenus)

Promesse concrète vs promesse générique

Niveau de friction : « Est-ce que mardi à 15 h vous convient ? » vs « À qui dois-je m’adresser ? »

Commencez par changer l’angle complet de votre message avant de vous obsessionner sur l’objet. Une offre faible ne sera pas sauvée par un objet ingénieux.

3. Optimisez la première ligne (les 150 premiers caractères)

Les 150 premiers caractères sont ce que les prospects voient dans l’aperçu de l’e-mail. C’est là que vous décidez s’ils ouvrent ou non.

Testez :

Personnalisation réelle (événement récent, signal public) vs modèle générique

Question directe vs courte déclaration

Contexte pertinent vs proposition directe

La personnalisation authentique basée sur une vraie recherche bat toujours les modèles avec des jetons dynamiques. « J’ai vu que vous avez recruté un Head of Sales en décembre » n’est pas la même chose que « Bonjour {{name}} ».

4. Expérimentez avec différents CTA (appels à l’action)

Le CTA définit le niveau de friction de votre message. Un CTA en une étape (directement vers un rendez-vous) peut fonctionner avec des audiences tièdes, mais un CTA en deux étapes obtient généralement de meilleurs résultats dans l’e-mail de prospection.

Options à tester :

CTA en 1 étape : « Est-ce que mardi ou jeudi à 11 h vous convient ? »

CTA en 2 étapes : « Est-ce que cela a du sens d’en parler 15 minutes ? »

CTA fermé vs ouvert

Question directe vs proposition douce

Selon votre ICP et le niveau de conscience du problème, le CTA optimal varie radicalement.

5. Trouvez la longueur idéale pour votre audience

Il n’existe pas de longueur « parfaite » pour tous les ICP. 40 à 70 mots fonctionnent généralement bien pour des décideurs très occupés, tandis que 90 à 130 mots peuvent mieux convenir à des acheteurs techniques ayant besoin de contexte.

Testez :

E-mail court et direct vs e-mail avec davantage de contexte

1 idée par e-mail vs 2 idées (plus d’infos, plus de bruit)

Structure des paragraphes : un long vs plusieurs courts

Règle générale : plus le rôle est senior, plus l’e-mail doit être court. Mais testez toujours avec votre vraie audience.

6. Concevez des expériences qui isolent la vraie causalité

Un test mal conçu vous donne de faux gagnants. Pour isoler la vraie causalité :

Règles minimales :

1 hypothèse, 1 variable principale, 1 KPI

Vraie randomisation au niveau du lead

Conserver constants : domaine, cadence d’envoi, nombre de relances, segmentation, calendrier

Ne mélangez pas les ICP : stratifiez par type de domaine (gmail/outlook/corporate), pays ou vertical

Si vous testez objet ET longueur ET CTA en même temps, vous ne saurez pas ce qui a provoqué le résultat. Un changement par test.

7. Calculez la taille d’échantillon avant de commencer

Dans l’e-mail de prospection, les taux sont faibles (1 % à 8 %). Avec de faibles conversions, vous avez besoin de grands échantillons pour détecter de vraies améliorations.

Exemples approximatifs (par variante) :

Base 4 % → 5,5 % (+1,5 point) : environ 3 100 contacts par variante

Base 4 % → 5 % (+1 point) : environ 6 700 par variante

Base 1 % → 1,5 % (+0,5 point) : environ 7 700 par variante

Si vous n’avez pas ce volume, ne forcez pas la significativité. Cumulez les tests, utilisez des cycles hebdomadaires ou regroupez les apprentissages par segments similaires. Des outils comme Optimizely ou Evan Miller proposent des calculateurs de taille d’échantillon pour les tests de proportions.

8. Évitez d’arrêter le test quand « il semble gagner »

Vérifier les résultats toutes les heures et arrêter dès que le gagnant vous plaît gonfle les faux positifs. Définissez les critères d’arrêt avant de commencer.

Pièges statistiques courants :

Arrêter quand « il semble gagner » (problème d’échantillonnage séquentiel)

Tester trop de variantes à la fois (comparaisons multiples)

Solution : définissez un échantillon minimum ou un test séquentiel bien planifié avant de commencer. Respectez les critères même si c’est difficile.

9. Surveillez la délivrabilité pendant le test

Vos tests peuvent « gagner » pour de mauvaises raisons. Si vous modifiez des éléments qui affectent les filtres (tracking agressif, liens, mots spammy), vous pouvez modifier le placement en boîte de réception et biaiser les résultats.

Signaux à surveiller :

Gmail exige l’authentification (SPF, DKIM, DMARC) pour les expéditeurs en volume

Outlook durcit les critères pour les expéditeurs à fort volume (acheminement vers les indésirables pour les non conformes à partir de mai 2025)

Mettez en place une désinscription facile et une désinscription en un clic avec la RFC 8058

Ajoutez des garde-fous de « stop-loss » : si les rebonds ou les plaintes dépassent le seuil, arrêtez même si le KPI augmente.

10. Mesurez la « réponse positive » de manière opérationnelle

Classez automatiquement les réponses, mais vérifiez un échantillon :

Positive : intérêt réel, demande d’informations, acceptation d’un rendez-vous, orientation vers le décideur

Neutre : « pas maintenant », « revenez au T2 », « envoyez-moi quelque chose »

Négative : « non », « ce n’est pas pertinent », « désinscrire »

Bruit : OOO, réponses automatiques, rebonds

Optimisez pour les « positifs » et les « rendez-vous », pas pour les réponses totales. Un taux de réponse de 15 % ne veut rien dire si 12 % sont « pas intéressé ».

Pourquoi le test A/B dans l’e-mail de prospection diffère du marketing par e-mail

Faibles volumes et conversions plus complexes

Dans le marketing par e-mail traditionnel, vous pouvez lancer des tests avec des millions d’envois et optimiser les clics. Dans l’e-mail de prospection, vous travaillez avec des centaines ou des milliers de contacts et vous optimisez les vraies conversations.

Tout change :

Vous avez besoin de plus de discipline dans la conception expérimentale

Les tailles d’échantillon sont plus petites, donc la significativité statistique est plus difficile à atteindre

Vous ne pouvez pas vous permettre de « tester 10 variantes » en même temps

La délivrabilité est plus fragile

Dans l’e-mail de prospection, la réputation du domaine se construit lentement et se casse rapidement. Un test mal exécuté peut brûler votre domaine en quelques jours.

Différences clés :

En marketing : utilisateurs inscrits, fort engagement, faible taux de spam

En e-mail de prospection : contact non sollicité, faible engagement, forte sensibilité aux filtres

C’est pourquoi chaque test doit inclure des garde-fous de délivrabilité.

Le contexte compte plus que le texte

Dans l’e-mail de prospection, le timing, l’ICP et le canal comptent autant, voire plus, que les mots exacts. Un message parfait envoyé à la mauvaise personne ou au mauvais moment échoue.

Cela signifie que vous devez stratifier vos tests par segments pertinents : rôle, vertical, taille d’entreprise, zone géographique. Ce qui fonctionne pour des CTO dans des startups tech peut échouer complètement avec des CFO dans l’industrie manufacturière.

Les plus grosses erreurs lors du test A/B dans l’e-mail de prospection

1. Tester sans volume suffisant

L’erreur la plus courante : lancer un test avec 100 e-mails par variante et déclarer un gagnant avec 2 réponses de plus.

Avec des conversions de 3 à 5 %, vous avez besoin de milliers de contacts pour détecter des améliorations de 1 à 2 %. Si vous n’avez pas ce volume, il vaut mieux :

Accumuler les apprentissages sur plusieurs semaines

Tester des changements plus importants (effet minimal détectable de 3 à 5 %)

Utiliser une approche qualitative et apprendre des réponses obtenues

2. Changer plusieurs variables à la fois

Vous testez simultanément l’objet, la longueur, le CTA et l’offre. Le résultat « gagne », mais vous ne savez pas pourquoi.

Conséquence : vous ne pouvez pas reproduire l’apprentissage dans d’autres campagnes. Le savoir n’est pas transférable.

Solution : 1 hypothèse, 1 variable, 1 test.

3. Ignorer la segmentation de l’ICP

Ce qui fonctionne pour un segment peut échouer complètement dans un autre. Un message qui résonne avec des startups tech peut sembler ridicule aux entreprises industrielles traditionnelles.

Problème : vous faites la moyenne de résultats issus d’ICP très différents et tirez des conclusions invalides.

Solution : stratifiez selon les variables clés (vertical, taille, rôle, géographie) et analysez les résultats par segment.

4. Optimiser les mauvaises métriques

Vous optimisez le taux d’ouverture parce qu’il est facile à mesurer. Le problème : les ouvertures ne se transforment pas en rendez-vous.

Pièges de métriques :

Taux d’ouverture : gonflé par Apple Mail Privacy, ne prédit pas la réponse

Taux de réponse total : inclut les « pas intéressé », les OOO et les rebonds

CTR : les clics sans contexte ne génèrent pas de pipeline

Solution : optimisez pour la réponse positive, les conversations utiles et les rendez-vous planifiés.

Comment la prospection multicanale affecte le test A/B

E-mail + LinkedIn + appels = contexte complet

Traditionnellement, la prospection commerciale se fait via des canaux isolés (e-mail, LinkedIn, appels de prospection). Cela fragmente le contexte et rend difficile la compréhension du canal ou du message qui a généré la réponse.

En prospection multicanale :

Un prospect peut voir votre e-mail, visiter votre profil LinkedIn et répondre plusieurs jours plus tard

La « conversion » peut venir de la combinaison des points de contact, et non d’un seul

La mesure de l’attribution devient complexe

Implication pour le test A/B : si vous faites de la prospection multicanale, vos tests d’e-mail doivent tenir compte de l’effet des autres canaux.

Testez des cadences complètes, pas des messages isolés

Au lieu de tester uniquement le premier e-mail, testez la cadence complète :

E-mail 1 (jour 0) + connexion LinkedIn (jour 2) + E-mail 2 (jour 5) + appel (jour 7)

vs

E-mail 1 (jour 0) + E-mail 2 (jour 3) + message LinkedIn (jour 5) + E-mail 3 (jour 8)

Cela demande plus de volume et une conception expérimentale plus robuste, mais vous donne des apprentissages bien plus actionnables sur le flux complet.

Attribution : quel point de contact a généré la réponse

Si quelqu’un répond après avoir reçu 3 e-mails et 2 messages LinkedIn, lequel a généré la conversion ?

Modèles d’attribution possibles :

Premier contact : le premier point de contact reçoit le crédit

Dernier contact : le dernier point de contact avant la réponse

Multi-touch : répartition proportionnelle entre tous les points de contact

Décroissance temporelle : plus de poids aux points de contact récents

Pour l’e-mail de prospection, le modèle le plus utile est généralement le dernier contact ou la décroissance temporelle, car les prospects ont tendance à répondre après avoir vu votre message plusieurs fois.

Le rôle de l’infrastructure technique dans le test A/B

Authentification : SPF, DKIM et DMARC

Si votre authentification n’est pas correctement configurée, vous pouvez « gagner » un test simplement parce qu’une variante est mieux délivrée, et non parce que le texte est meilleur.

Exigences minimales :

SPF : autorise les IP/hôtes à envoyer pour votre domaine

DKIM : signature cryptographique qui valide que le message n’a pas été modifié

DMARC : relie SPF et DKIM au domaine From et définit la politique

Gmail précise que pour le courrier direct, le domaine From doit correspondre au domaine SPF ou DKIM pour être conforme à DMARC. Microsoft a des exigences similaires pour les expéditeurs à fort volume.

Pour le test A/B : gardez la même configuration d’authentification dans toutes les variantes. Si vous changez de domaine d’envoi entre A et B, vous introduisez une variable technique qui biaise les résultats.

Domaines d’envoi et montée en température

Un nouveau domaine sans réputation aura une délivrabilité moins bonne qu’un domaine établi. Si vous testez avec différents domaines, vous ne testez pas le texte, vous testez la réputation.

Règles :

Utilisez le même sous-domaine d’envoi pour toutes les variantes du test

Si vous devez passer à l’échelle et ajouter des domaines, faites-le après le test, pas pendant

Maintenez le même schéma de warmup (volume, fréquence, engagement) entre les variantes

Pixels de suivi et liens : comment ils affectent les filtres

Les pixels de suivi et les raccourcisseurs d’URL peuvent déclencher les filtres anti-spam.

Impact sur le test A/B :

Si une variante a un tracking agressif et pas l’autre, la différence de délivrabilité peut être énorme

Les raccourcisseurs d’URL (bit.ly, ow.ly) sont des signaux de spam pour de nombreux filtres

Gmail et Outlook peuvent filtrer les e-mails avec un fort ratio de liens

Solution : maintenez le même niveau de suivi et la même structure de liens dans toutes les variantes. Si vous voulez tester des CTA avec des liens, utilisez le même nombre de liens avec des URL de longueur similaire.

Seed testing pour mesurer le placement en boîte de réception

Vous pouvez « gagner » un test parce qu’une variante tombe moins dans les spams, et non parce qu’elle génère plus de réponses.

Le seed testing permet de mesurer le placement (boîte de réception vs spam vs manquant) avec des comptes de contrôle avant de passer à l’échelle.

Comment l’appliquer :

Envoyez A et B avec le même schéma à une liste de seed (comptes Gmail, Outlook, corporate)

Mesurez le placement réel : combien arrivent en boîte de réception, combien en spam

Si A « gagne » en réponses mais que son placement tombe en spam chez certains fournisseurs, vous achetez une performance à court terme et une dégradation à moyen terme

Les outils de délivrabilité proposent généralement des seed tests, mais vous pouvez créer votre propre configuration avec des comptes de test.

Considérations juridiques et de conformité en Espagne/UE

LSSI et consentement préalable

En Espagne, l’envoi de communications commerciales par e-mail est encadré par la LSSI (règle générale : consentement préalable ; exception habituelle : relation contractuelle préalable et produits/services similaires).

Pour la prospection B2B à froid, cela crée une friction juridique. L’AEPD l’a réaffirmé dans des résolutions et critères.

Minimisez le risque :

Transparence : qui vous êtes, pourquoi vous contactez

Désinscription claire dans le premier e-mail

Registres d’opposition et de suppression

Revue juridique selon le pays, le type de données et le destinataire

RGPD et bases juridiques pour le traitement des données

Pour le traitement des données personnelles dans le marketing direct sous le RGPD, vous devez disposer d’une base juridique, respecter les attentes raisonnables et le droit d’opposition.

Bases juridiques les plus courantes en B2B :

Consentement : difficile à obtenir dans l’e-mail de prospection

Intérêt légitime : possible si le prospect est pertinent pour votre activité et si la prospection est raisonnable

Exécution du contrat : uniquement s’il existe une relation préalable

Le cadre ePrivacy influence également. La combinaison RGPD + ePrivacy + LSSI fait de l’e-mail B2B à froid en Espagne un terrain complexe.

Impact sur le test A/B

Problème : si votre base juridique est faible ou si votre processus de désinscription n’est pas clair, vous pouvez recevoir davantage de plaintes pour spam dans certains tests, non pas à cause du texte mais à cause de la perception d’intrusion.

Solution :

Incluez toujours un mécanisme de désinscription clair (de préférence en un clic)

Ajoutez de la transparence sur qui vous êtes et pourquoi vous contactez

Maintenez des listes de suppression à jour et respectez immédiatement les désinscriptions

Considérez que certains tests peuvent augmenter la friction juridique s’ils sont plus agressifs dans le ton ou la fréquence

Modèle de briefing pour chaque test A/B

Avant de lancer un test, documentez :

1. Hypothèse : « Si nous changeons X, Y augmentera parce que Z »

2. Variable : une seule (offre, première ligne, CTA, longueur, objet)

3. KPI : réponse positive / rendez-vous planifié

4. MDE (effet minimal détectable) : amélioration minimale qui vaut l’effort (exemple : +1 point de réponse)

5. Échantillon minimum par variante : calculé avec un outil statistique

6. Segments : ICP et strates (gmail/outlook/corporate, pays, vertical, rôle)

7. Garde-fous : rebond <2 %, plaintes pour spam <0,1 %, désinscriptions <0,5 %

8. Critères d’arrêt : date fixe ou minimum n atteint

9. Décision : A gagne / B gagne / non concluant (pas de significativité)

10. Enseignement documenté : ce que vous réutilisez et dans quelles futures campagnes

Ce briefing vous oblige à réfléchir avant d’exécuter et évite les tests improvisés qui gaspillent du volume.

3 scénarios réels où le test A/B génère des résultats

Start-up SaaS qui accélère la prospection avec une petite équipe

Une start-up avec 2 SDR doit maximiser chaque contact. Elle ne peut pas se permettre de gaspiller des leads avec des messages génériques.

Utilisation du test A/B :

Elle teste l’offre (ROI vs gain de temps) avec 1 500 leads par variante

Elle découvre que le « gain de temps » génère +2,3 points de réponses positives

Elle applique l’apprentissage à toutes les cadences futures

En 3 mois, elle double les rendez-vous sans augmenter le volume

Point clé : avec un faible volume, elle privilégie les tests à fort impact (offre, angle) avant les détails (objet, signature).

Entreprise industrielle lançant un nouveau produit

Une entreprise B2B industrielle veut valider les messages d’un nouveau produit avant d’investir dans davantage de SDR.

Utilisation du test A/B :

Elle teste 3 angles différents : réduction des coûts, conformité réglementaire, efficacité opérationnelle

Elle segmente par vertical : fabrication vs logistique vs construction

Elle découvre que la conformité réglementaire fonctionne mieux dans la construction, tandis que la réduction des coûts l’emporte dans la fabrication

Résultat : elle personnalise les messages par vertical et améliore le taux de rendez-vous de +40 % par rapport au message générique.

Point clé : segmentation ICP et enseignements spécifiques par vertical.

Agence growth testant des cadences multicanales

Une agence gère la prospection pour plusieurs clients et veut optimiser des cadences complètes.

Utilisation du test A/B :

Cadence A : E-mail (jour 0) → LinkedIn (jour 2) → E-mail (jour 5) → Appel (jour 8)

Cadence B : E-mail (jour 0) → E-mail (jour 3) → Message LinkedIn (jour 5) → E-mail (jour 7)

Elle mesure l’attribution par dernier contact et décroissance temporelle

Résultat : la cadence A génère plus de réponses précoces, mais la cadence B affiche un meilleur taux de rendez-vous final (+15 %).

Point clé : testez des flux complets, pas des messages isolés.

Pourquoi Enginy AI facilite le test A/B dans l’e-mail de prospection sans sacrifier la délivrabilité

Réaliser un test A/B rigoureux dans l’e-mail de prospection exige de l’infrastructure, des données propres et une exécution cohérente. C’est là que beaucoup d’entreprises bloquent : elles veulent tester mais n’ont pas la configuration nécessaire.

Données enrichies et segmentation précise

Enginy agrège des données issues de plus de 30 sources et utilise l’enrichissement waterfall avec plusieurs fournisseurs, au-delà des logiciels classiques de génération de leads. Cela vous apporte :

Couverture complète : e-mails valides, rôles mis à jour, signaux d’intention

Segmentation précise : vous pouvez stratifier les tests par vertical, taille, rôle, géographie

Hygiène des données : réduire les rebonds et améliorer la délivrabilité dès le départ

Lorsque vos données sont propres et complètes, vos tests sont plus fiables parce que vous éliminez le bruit causé par des e-mails invalides ou des rôles incorrects.

Exécution multicanale cohérente

Traditionnellement, la prospection commerciale se fait par canaux isolés (e-mail, LinkedIn, téléphone…). Avec Enginy, un outil de prospection B2B moderne, vous pouvez intégrer toute la prospection dans un flux automatisé unique, avec des données centralisées pour prendre des décisions plus intelligentes.

Cela facilite le test A/B de cadences complètes :

E-mail + LinkedIn + relance dans un seul flux

Attribution claire du point de contact qui a généré la réponse

Cohérence du timing et de la séquence entre les variantes

Lorsque tous les canaux sont connectés, vous pouvez tester des stratégies complètes au lieu de messages isolés.

Infrastructure de délivrabilité contrôlée

Enginy vous permet de maintenir des garde-fous techniques pendant les tests :

Même authentification (SPF, DKIM, DMARC) dans toutes les variantes

Suivi des rebonds, plaintes pour spam et placement

Warmup contrôlé et volume cohérent

Cela garantit que vos « gagnants » sont réellement meilleurs en termes de texte, et pas simplement mieux délivrés grâce à une configuration technique différente.

Intégration CRM pour mesurer la vraie conversion

Grâce à une intégration CRM robuste, Enginy s’intègre facilement aux CRM existants (HubSpot, Salesforce, Pipedrive), sans qu’il soit nécessaire de les remplacer. Cela vous permet de :

Mesurer la conversion de bout en bout : de l’e-mail au rendez-vous et à l’opportunité

Calculer le vrai ROI de chaque variante

Fermer la boucle entre la prospection et le pipeline

Sans intégration CRM, vous ne pouvez mesurer que les réponses. Avec l’intégration, vous mesurez l’impact business.

Productivité : faire plus de tests avec moins de ressources

Enginy AI permet aux équipes commerciales d’être beaucoup plus productives, en automatisant les tâches répétitives et en économisant des heures de travail, et complète vos outils de vente IA existants.

Au lieu de configurer manuellement chaque test, segmenter les listes, lancer les cadences et consolider les résultats dans des feuilles de calcul, vous pouvez :

Configurer les tests en quelques minutes

Exécuter les variantes avec une cohérence automatique

Obtenir des rapports de résultats segmentés par ICP

Cela signifie que vous pouvez faire plus de tests avec moins d’effort et apprendre plus vite.

Foire aux questions (FAQ)

Qu’est-ce que le test A/B dans l’e-mail de prospection ?

Le test A/B dans l’e-mail de prospection est une méthode expérimentale où vous envoyez deux versions d’un message (A et B) à des groupes aléatoires de prospects afin de déterminer laquelle génère les meilleurs résultats. Contrairement au marketing par e-mail, dans l’e-mail de prospection vous optimisez les réponses positives et les rendez-vous, pas les clics.

Combien de contacts me faut-il pour un test A/B valide ?

Cela dépend de votre base de référence (taux de conversion actuel) et de l’amélioration minimale que vous voulez détecter. À titre de référence :

Pour passer de 4 % à 5,5 % de réponses positives : environ 3 100 contacts par variante

Pour passer de 4 % à 5 % : environ 6 700 par variante

Pour passer de 1 % à 1,5 % : environ 7 700 par variante

Sans volume suffisant, il vaut mieux accumuler les apprentissages sur plusieurs semaines ou tester des changements plus importants.

Que dois-je tester en premier dans l’e-mail de prospection ?

Priorisez les variables ayant le plus grand impact sur la réponse :

L’offre et l’angle : principal point de douleur, promesse, niveau de friction

La première ligne (les 150 premiers caractères) : personnalisation vs modèle

Le CTA : 1 étape vs 2 étapes, fermé vs ouvert

La longueur et la structure : court vs avec contexte supplémentaire

Gardez les objets et les signatures pour plus tard. L’offre compte 10 fois plus que l’objet.

Pourquoi le taux d’ouverture n’est-il pas une bonne métrique ?

La protection de confidentialité Apple Mail précharge le contenu et peut gonfler artificiellement les ouvertures. De plus, les ouvertures ne prédisent pas les réponses positives : quelqu’un peut ouvrir par curiosité et ne jamais répondre.

Meilleures métriques :

Taux de réponse positive (intérêt réel, acceptation d’un rendez-vous)

Taux de rendez-vous planifiés

Taux de conversion en opportunité dans le CRM

Optimisez pour des conversations utiles, pas pour la curiosité.

Comment éviter de brûler mon domaine pendant les tests ?

Garde-fous de délivrabilité :

Maintenez les plaintes pour spam <0,1 % (Gmail recommande <0,10 %)

Maintenez le taux de rebond <2 %

Mettez en place une authentification complète : SPF, DKIM, DMARC

Utilisez la désinscription en un clic (RFC 8058)

Ne changez pas l’infrastructure technique entre les variantes

Si une variante augmente les plaintes ou les rebonds, arrêtez immédiatement, même si le KPI augmente.

Puis-je tester plusieurs variables en même temps ?

Techniquement oui (plan factoriel), mais ce n’est pas recommandé pour la plupart des équipes. Tester plusieurs variables nécessite :

Beaucoup plus d’échantillon (x4 pour un factoriel 2x2)

Une analyse statistique plus complexe

Un risque d’interactions qui brouillent les résultats

Meilleure approche : 1 hypothèse, 1 variable, 1 test. Apprenez, appliquez, répétez.

Comment mesurer si une réponse est « positive » ?

Classez manuellement un échantillon puis automatisez :

Positive : « Je suis intéressé », « parlons-en », « dites-m’en plus », mentionne le décideur, accepte un rendez-vous

Neutre : « pas maintenant », « revenez au T2 », « envoyez-moi des infos »

Négative : « pas intéressé », « ce n’est pas pertinent », « désinscrire »

Bruit : OOO, réponses automatiques, rebonds

N’optimisez que pour les positifs. Un taux de réponse de 15 % n’aide pas si 12 % sont des « non merci ».

Combien de temps doit durer un test A/B ?

Cela dépend de votre volume d’envoi et de votre cycle de réponse :

Minimum : le temps d’atteindre l’échantillon minimum calculé

Recommandé : 2 à 3 semaines pour capter les réponses tardives et les effets de relance

Maximum : 1 mois (au-delà, des facteurs externes peuvent contaminer)

Règle : définissez les critères d’arrêt avant de commencer et respectez-les, même si « il semble gagner » plus tôt.

Comment fonctionne le test A/B si je fais de la prospection multicanale ?

Dans la prospection multicanale (e-mail + LinkedIn + appels), le test A/B se complique parce que la conversion peut venir de la combinaison des points de contact.

Meilleure approche :

Testez des cadences complètes, pas des messages isolés

Utilisez une attribution dernier contact ou décroissance temporelle pour attribuer le crédit

Conservez tous les canaux constants sauf la variable que vous testez

Si vous changez l’e-mail et LinkedIn en même temps, vous ne saurez pas lequel a généré le résultat.

Enginy peut-il m’aider avec le test A/B dans l’e-mail de prospection ?

Oui. Enginy facilite un test A/B rigoureux en fournissant :

Données enrichies issues de plus de 30 sources pour une segmentation précise

Exécution multicanale cohérente (e-mail + LinkedIn) dans un seul flux

Infrastructure contrôlée pour maintenir une délivrabilité stable

Intégration CRM pour mesurer la vraie conversion (rendez-vous, opportunités)

Automatisation qui vous permet de faire plus de tests sans plus de ressources

Cela vous permet de tester rigoureusement des stratégies complètes, et pas seulement de changer les objets.