10 unverzichtbare A/B-Testing-Strategien für Kaltakquise-E-Mails im Jahr 2026

Andrea Lopez

Teilen

Dies sind die besten Strategien für A/B-Tests von Cold-E-Mails, um die Konversion 2026 zu verbessern:

Das richtige Ziel festlegen (Öffnungen nicht mehr als Hauptmetrik verwenden)

Angebot und Ansatz vor der Betreffzeile testen

Den ersten Satz optimieren (erste 150 Zeichen)

Mit verschiedenen CTAs (Handlungsaufforderungen) experimentieren

Die ideale Länge für Ihre Zielgruppe finden

Experimente so gestalten, dass sie echte Kausalität isolieren

Die Stichprobengröße vor dem Start berechnen

Vermeiden, den Test zu stoppen, wenn es so aussieht, als würde er gewinnen

Die Zustellbarkeit während des Tests überwachen

Positive Antworten operativ messen

A/B-Tests in Cold-E-Mails sind 2026 nicht mehr nur eine Frage von Betreffzeilen-Tweaks und dem Jagen von Öffnungsraten.

Zwischen Datenschutzänderungen (die Öffnungen verzerren), strengeren Spam-Filtern und der Realität von Multichannel-Outreach bedeutet echte Optimierung, aussagekräftige Ergebnisse zu verfolgen: positive Antworten, gebuchte Meetings und Pipeline-Konversion, ohne die Zustellbarkeit zu beeinträchtigen.

Der Unterschied zwischen einem Test, der Wachstum vorantreibt, und einem, der Sie in die Irre führt, hängt meist von den Grundlagen ab: einer klaren Hypothese, einer primären Variable pro Experiment, echter Randomisierung und unverzichtbaren Leitplanken ( Bounces, Spam-Beschwerden, Abmeldungen, Posteingangsplatzierung ).

Ohne diese kann Ihr „Gewinner“ einfach die Variante sein, die häufiger im Posteingang landet, nicht die, die besser überzeugt.

In diesem Beitrag finden Sie 10 essenzielle Strategien, um A/B-Tests für Cold-E-Mails richtig durchzuführen: priorisieren Sie Angebot und Ansatz gegenüber kosmetischen Anpassungen, optimieren Sie die ersten 150 Zeichen, passen Sie CTAs an den Problembewusstseinsgrad an, berechnen Sie die Stichprobengröße, setzen Sie Stoppkriterien und lernen Sie vor allem segmentbezogen, damit Ihre Erkenntnisse übertragbar und nicht nur Rauschen sind.

10 essenzielle A/B-Test-Strategien für Cold-E-Mails zur Verbesserung der Konversion 2026

1. Das richtige Ziel definieren (Öffnungen als Hauptmetrik vergessen)

Die Öffnungsrate ist ein schwaches und zunehmend unzuverlässiges Signal. Apple Mail Privacy Protection lädt Inhalte vor, kann Öffnungen künstlich aufblähen und verbirgt echte Standort- und Zeitdaten. Nur auf Öffnungen zu optimieren führt zu falschen Schlussfolgerungen.

Bessere Metrik-Hierarchie:

Primäre KPI: Rate positiver Antworten oder Meeting-Buchungsrate

Sekundär: Gesamtzahl der Antworten, CTR bei Links, Konversionsrate zu Demo

Leitplanken: Bounce-Rate, Spam-Beschwerden, Abmeldungen, Zustellung/Posteingangsplatzierung

Gmail empfiehlt, die Spam-Rate unter 0,10 % zu halten und 0,30 % oder mehr zu vermeiden. In Outlook sollte die Beschwerderate laut SNDS unter 0,3 % bleiben.

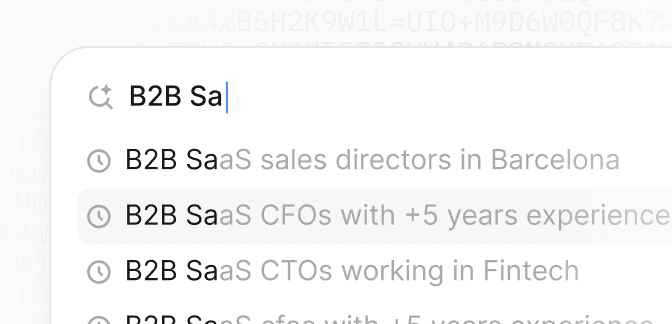

2. Angebot und Ansatz vor der Betreffzeile testen

Die erste Variable, die Sie testen sollten, ist die mit dem größten Einfluss auf die Antwort: Ihr Wertversprechen.

Hochwirksame Angebotsvariablen:

Hauptschmerzpunkt oder Auslöser (Kosten, Risiko, Zeit, Umsatz)

Konkretes Versprechen statt generischem Versprechen

Reibungsgrad: „Passt Dienstag um 15 Uhr?“ vs. „An wen sollte ich mich wenden?“

Beginnen Sie damit, den gesamten Ansatz Ihrer Nachricht zu ändern, bevor Sie sich auf Betreffzeilen versteifen. Ein schwaches Angebot wird durch eine clevere Betreffzeile nicht gerettet.

3. Die erste Zeile optimieren (erste 150 Zeichen)

Die ersten 150 Zeichen sind das, was Interessenten in der E-Mail-Vorschau sehen. Hier entscheiden Sie, ob sie öffnen oder nicht.

Testen:

Echte Personalisierung (aktuelles Ereignis, öffentliches Signal) vs. generische Vorlage

Direkte Frage vs. kurze Aussage

Relevanter Kontext vs. direkter Pitch

Echte Personalisierung, die auf realer Recherche basiert, schlägt immer Vorlagen mit dynamischen Tokens. „Ich habe gesehen, dass Sie im Dezember einen Head of Sales eingestellt haben“ ist nicht dasselbe wie „Hallo {{name}}“.

4. Mit verschiedenen CTAs experimentieren (Handlungsaufforderungen)

Der CTA definiert die Reibung Ihrer Nachricht. Ein ein Schritt-CTA (direkt zum Meeting) kann bei warmen Zielgruppen funktionieren, aber ein zwei Schritt-CTA erzielt in Cold-E-Mails meist bessere Antworten.

Zu testende Optionen:

1-Schritt-CTA: „Passt Dienstag oder Donnerstag um 11 Uhr für Sie?“

2-Schritt-CTA: „Macht es Sinn, 15 Minuten zu sprechen?“

Geschlossener vs. offener CTA

Direkte Frage vs. weiche Formulierung

Je nach Ihrem ICP und dem Grad des Problembewusstseins variiert der optimale CTA drastisch.

5. Die ideale Länge für Ihre Zielgruppe finden

Es gibt keine „perfekte“ Länge für alle ICPs. 40–70 Wörter funktionieren meist gut bei sehr beschäftigten Entscheidern, während 90–130 Wörter für technische Käufer, die Kontext brauchen, besser funktionieren können.

Testen:

Kurze und direkte E-Mail vs. E-Mail mit mehr Kontext

1 Idee pro E-Mail vs. 2 Ideen (mehr Informationen, mehr Rauschen)

Absatzstruktur: ein langer vs. mehrere kurze Absätze

Faustregel: Je höher die Position, desto kürzer die E-Mail. Testen Sie aber immer mit Ihrer realen Zielgruppe.

6. Experimente so gestalten, dass sie echte Kausalität isolieren

Ein schlecht gestalteter Test liefert falsche Gewinner. Um echte Kausalität zu isolieren:

Mindestregeln:

1 Hypothese, 1 Hauptvariable, 1 KPI

Echte Randomisierung auf Lead-Ebene

Konstant halten: Domain, Sende-Muster, Anzahl der Follow-ups, Segmentierung, Kalender

ICPs nicht mischen: nach Domain-Typ (Gmail/Outlook/Corporate), Land oder Branche stratifizieren

Wenn Sie Betreff, Länge UND CTA gleichzeitig testen, wissen Sie nicht, was das Ergebnis verursacht hat. Eine Änderung pro Test.

7. Die Stichprobengröße vor dem Start berechnen

Bei Cold-E-Mails sind die Raten niedrig (1 %–8 %). Bei niedrigen Konversionsraten brauchen Sie große Stichproben, um echte Verbesserungen zu erkennen.

Ungefähre Beispiele (pro Variante):

Ausgangswert 4 % → 5,5 % (+1,5 Punkte): ca. 3.100 Kontakte pro Variante

Ausgangswert 4 % → 5 % (+1 Punkt): ca. 6.700 pro Variante

Ausgangswert 1 % → 1,5 % (+0,5 Punkte): ca. 7.700 pro Variante

Wenn Sie dieses Volumen nicht haben, erzwingen Sie keine Signifikanz. Sammeln Sie Tests über mehrere Wochen, nutzen Sie wöchentliche Zyklen oder fassen Sie Erkenntnisse über ähnliche Segmente zusammen. Tools wie Optimizely oder Evan Miller bieten Stichprobengrößenrechner für Anteilstests.

8. Vermeiden, den Test zu stoppen, wenn es so aussieht, als würde er gewinnen

Wenn Sie stündlich Ergebnisse prüfen und stoppen, sobald Ihnen der Gewinner gefällt, erhöht das die Zahl falscher Positivbefunde. Definieren Sie Stoppkriterien vor dem Start.

Häufige statistische Fallen:

Stoppen, wenn es so aussieht, als würde es gewinnen (Problem der sequentiellen Stichproben)

Zu viele Varianten gleichzeitig testen (multiple Vergleiche)

Lösung: Definieren Sie vor dem Start eine Mindeststichprobe oder ein gut geplantes sequentielles Testen. Halten Sie sich an die Kriterien, auch wenn es schwerfällt.

9. Die Zustellbarkeit während des Tests überwachen

Ihre Tests können aus den falschen Gründen „gewinnen“. Wenn Sie Dinge ändern, die Filter beeinflussen (aggressives Tracking, Links, spamartige Wörter), können Sie die Posteingangsplatzierung verändern und die Ergebnisse verzerren.

Zu überwachende Signale:

Gmail verlangt für Bulk-Sender Authentifizierung (SPF, DKIM, DMARC)

Outlook verschärft die Kriterien für Sender mit hohem Volumen (ab Mai 2025 bei Nicht-Einhaltung Weiterleitung in Junk)

Einfaches Abmelden und One-Click-Unsubscribe gemäß RFC 8058 umsetzen

Fügen Sie „Stop-Loss“-Leitplanken hinzu: Wenn Bounces oder Beschwerden über den Schwellenwert steigen, stoppen Sie, auch wenn die KPI steigt.

10. „Positive Antwort“ operativ messen

Klassifizieren Sie Antworten automatisch, aber prüfen Sie eine Stichprobe:

Positiv: echtes Interesse, bittet um Informationen, akzeptiert ein Meeting, verweist an den Entscheidungsträger

Neutral: „nicht jetzt“, „versuchen Sie es in Q2“, „schicken Sie mir etwas“

Negativ: „nein“, „passt nicht“, „abmelden“

Rauschen: OOO, automatische Antworten, Bounces

Optimieren Sie auf „positive Antworten“ und „Meetings“, nicht auf die Gesamtzahl der Antworten. Eine Antwortrate von 15 % bedeutet nichts, wenn 12 % „nicht interessiert“ sind.

Warum A/B-Tests in Cold-E-Mails sich vom E-Mail-Marketing unterscheiden

Niedrige Volumina und komplexere Konversionen

Im klassischen E-Mail-Marketing können Sie Tests mit Millionen von Sendungen durchführen und auf Klicks optimieren. In der Kaltakquise arbeiten Sie mit Hunderten oder Tausenden von Kontakten und optimieren auf echte Gespräche.

Das verändert alles:

Sie brauchen mehr Disziplin im experimentellen Design

Die Stichproben sind kleiner, daher ist statistische Signifikanz schwerer zu erreichen

Sie können es sich nicht leisten, „10 Varianten“ gleichzeitig zu testen

Zustellbarkeit ist fragiler

Bei Cold-E-Mails wächst Ihre Domain-Reputation langsam und bricht schnell ein. Ein schlecht ausgeführter Test kann Ihre Domain in wenigen Tagen verbrennen.

Wichtige Unterschiede:

Im Marketing: Nutzer haben sich angemeldet, hohes Engagement, niedrige Spam-Rate

Bei Cold-E-Mails: unaufgeforderter Kontakt, geringes Engagement, hohe Sensibilität gegenüber Filtern

Deshalb muss jeder Test Leitplanken für die Zustellbarkeit enthalten.

Kontext ist wichtiger als der Text

Bei Cold-E-Mails sind Timing, ICP und Kanal genauso wichtig oder wichtiger als die exakten Wörter. Eine perfekte Nachricht an die falsche Person oder zum falschen Zeitpunkt scheitert.

Das bedeutet, dass Sie Ihre Tests nach relevanten Segmenten stratifizieren müssen: Rolle, Branche, Unternehmensgröße, Geografie. Was für CTOs in Tech-Startups funktioniert, kann bei CFOs in der Fertigung komplett scheitern.

Die größten Fehler bei A/B-Tests in Cold-E-Mails

1. Testen ohne ausreichendes Volumen

Der häufigste Fehler: ein Test mit 100 E-Mails pro Variante zu starten und mit zwei zusätzlichen Antworten einen Gewinner auszurufen.

Bei 3–5 % Konversion brauchen Sie Tausende Kontakte, um Verbesserungen von 1–2 % zu erkennen. Wenn Sie dieses Volumen nicht haben, ist es besser:

Erkenntnisse über mehrere Wochen zu sammeln

Größere Änderungen zu testen (minimale nachweisbare Effektgröße von 3–5 %)

Einen qualitativen Ansatz zu nutzen und aus den Antworten zu lernen, die Sie erhalten

2. Mehrere Variablen gleichzeitig ändern

Sie testen Betreff, Länge, CTA und Angebot gleichzeitig. Das Ergebnis „gewinnt“, aber Sie wissen nicht warum.

Folge: Sie können das Gelernte nicht auf andere Kampagnen übertragen. Wissen ist nicht übertragbar.

Lösung: 1 Hypothese, 1 Variable, 1 Test.

3. ICP-Segmentierung ignorieren

Was für ein Segment funktioniert, kann in einem anderen komplett scheitern. Eine Nachricht, die bei Tech-Startups ankommt, kann auf traditionelle Industrieunternehmen lächerlich wirken.

Problem: Sie mitteln Ergebnisse sehr unterschiedlicher ICPs und ziehen ungültige Schlussfolgerungen.

Lösung: Nach wichtigen Variablen stratifizieren (Branche, Größe, Rolle, Geografie) und Ergebnisse pro Segment analysieren.

4. Auf die falschen Metriken optimieren

Sie optimieren auf die Öffnungsrate, weil sie leicht zu messen ist. Das Problem: Öffnungen führen nicht zu Meetings.

Metrikfallen:

Öffnungsrate: durch Apple Mail Privacy aufgebläht, sagt nichts über Antworten voraus

Gesamte Antwortrate: enthält „nicht interessiert“, OOO und Bounces

CTR: Klicks ohne Kontext erzeugen keine Pipeline

Lösung: Optimieren Sie auf positive Antworten, nützliche Gespräche und geplante Meetings.

Wie Multichannel-Prospecting A/B-Tests beeinflusst

E-Mail + LinkedIn + Anrufe = kompletter Kontext

Traditionell erfolgt Vertriebs-Prospecting über isolierte Kanäle (E-Mail, LinkedIn, Telefonakquise). Dadurch wird der Kontext fragmentiert und es wird schwierig zu verstehen, welcher Kanal oder welche Nachricht die Antwort ausgelöst hat.

Beim Multichannel-Prospecting:

Kann ein Interessent Ihre E-Mail sehen, Ihr LinkedIn besuchen und Tage später antworten

Kann die „Konversion“ aus der Kombination von Touchpoints entstehen, nicht nur aus einem einzigen

Wird die Attribution komplex

Implikation für A/B-Tests: Wenn Sie Multichannel-Outreach machen, müssen Ihre E-Mail-Tests die Wirkung anderer Kanäle berücksichtigen.

Komplette Sequenzen testen, nicht isolierte Nachrichten

Statt nur die erste E-Mail zu testen, testen Sie die komplette Sequenz:

E-Mail 1 (Tag 0) + LinkedIn-Verbindung (Tag 2) + E-Mail 2 (Tag 5) + Anruf (Tag 7)

vs

E-Mail 1 (Tag 0) + E-Mail 2 (Tag 3) + LinkedIn-Nachricht (Tag 5) + E-Mail 3 (Tag 8)

Das erfordert mehr Volumen und ein robusteres experimentelles Design, liefert Ihnen aber deutlich handlungsorientiertere Erkenntnisse über den gesamten Ablauf.

Attribution: Welcher Touchpoint hat die Antwort ausgelöst?

Wenn jemand nach 3 E-Mails und 2 LinkedIn-Nachrichten antwortet, welcher Touchpoint hat die Konversion ausgelöst?

Mögliche Attributionsmodelle:

First-Touch: Der erste Kontakt erhält den Kredit

Last-Touch: Letzter Touchpoint vor der Antwort

Multi-Touch: proportionale Verteilung auf alle Touchpoints

Time-Decay: Höheres Gewicht für jüngere Touchpoints

Für Cold-E-Mails ist meist das Last-Touch- oder Time-Decay-Modell am nützlichsten, weil Interessenten oft antworten, nachdem sie Ihre Nachricht mehrmals gesehen haben.

Die Rolle der technischen Infrastruktur bei A/B-Tests

Authentifizierung: SPF, DKIM und DMARC

Wenn Ihre Authentifizierung nicht korrekt eingerichtet ist, können Sie einen Test „gewinnen“, nur weil eine Variante besser zugestellt wird und nicht, weil der Text besser ist.

Mindestanforderungen:

SPF: autorisiert IPs/Hosts, für Ihre Domain zu senden

DKIM: kryptografische Signatur, die bestätigt, dass die Nachricht nicht verändert wurde

DMARC: verbindet SPF und DKIM mit der From-Domain und definiert die Richtlinie

Gmail gibt vor, dass bei Direktversand die From:-Domain mit der SPF- oder DKIM-Domain übereinstimmen muss, um DMARC-konform zu sein. Microsoft hat ähnliche Anforderungen für Sender mit hohem Volumen.

Für A/B-Tests: Halten Sie die gleiche Authentifizierungskonfiguration in allen Varianten ein. Wenn Sie zwischen A und B die Versanddomains ändern, führen Sie eine technische Variable ein, die die Ergebnisse verzerrt.

Versanddomains und Warmup

Eine neue Domain ohne Reputation hat eine schlechtere Zustellbarkeit als eine etablierte. Wenn Sie mit unterschiedlichen Domains testen, testen Sie nicht den Text, sondern die Reputation.

Regeln:

Verwenden Sie für alle Testvarianten dieselbe Versand-Subdomain

Wenn Sie skalieren und Domains hinzufügen müssen, tun Sie das nach dem Test, nicht währenddessen

Behalten Sie zwischen den Varianten dasselbe Warmup-Muster bei (Volumen, Frequenz, Engagement)

Tracking-Pixel und Links: Wie sie Filter beeinflussen

Tracking-Pixel und URL-Shortener können Spam-Filter auslösen.

Auswirkung auf A/B-Tests:

Wenn eine Variante aggressives Tracking hat und die andere nicht, kann der Zustellbarkeitsunterschied enorm sein

URL-Shortener (bit.ly, ow.ly) sind für viele Filter Spam-Signale

Gmail und Outlook können E-Mails mit hohem Link-Anteil filtern

Lösung: Behalten Sie in allen Varianten dasselbe Tracking-Niveau und dieselbe Link-Struktur bei. Wenn Sie CTAs mit Links testen wollen, verwenden Sie die gleiche Anzahl an Links mit ähnlich langen URLs.

Seed-Tests zur Messung der Posteingangsplatzierung

Sie können einen Test „gewinnen“, weil eine Variante seltener im Spam landet, nicht weil sie mehr Antworten generiert.

Seed-Tests ermöglichen es, die Platzierung (Posteingang vs. Spam vs. fehlt) mit Kontrollkonten zu messen, bevor Sie skalieren.

So wenden Sie es an:

Senden Sie A und B mit demselben Muster an eine Seed-Liste (Gmail-, Outlook-, Corporate-Konten)

Messen Sie die echte Platzierung: Wie viele landen im Posteingang, wie viele im Spam

Wenn A bei Antworten „gewinnt“, aber seine Platzierung bei bestimmten Anbietern in Spam abfällt, kaufen Sie kurzfristige Performance und mittelfristige Verschlechterung

Deliverability-Tools bieten meist Seed-Tests an, aber Sie können Ihr eigenes Setup mit Testkonten erstellen.

Rechtliche und Compliance-Aspekte in Spanien/EU

LSSI und vorherige Einwilligung

In Spanien ist der Versand kommerzieller Mitteilungen per E-Mail durch die LSSI geregelt (allgemeine Regel: vorherige Einwilligung; typische Ausnahme: vorherige Vertragsbeziehung und ähnliche Produkte/Dienstleistungen).

Für Cold B2B-Outreach schafft das rechtliche Reibung. Die AEPD hat dies in Beschlüssen und Kriterien wiederholt.

Risiko minimieren:

Transparenz: Wer Sie sind, warum Sie Kontakt aufnehmen

Klare Abmeldung in der ersten E-Mail

Dokumentation von Widersprüchen und Sperrlisten

Rechtliche Prüfung je nach Land, Datentyp und Empfänger

DSGVO und Rechtsgrundlagen für die Datenverarbeitung

Für die Verarbeitung personenbezogener Daten im Direktmarketing unter der DSGVO benötigen Sie eine Rechtsgrundlage, müssen angemessene Erwartungen respektieren und das Widerspruchsrecht beachten.

Die häufigsten Rechtsgrundlagen im B2B:

Einwilligung: in Cold-E-Mails schwer zu erhalten

Berechtigtes Interesse: möglich, wenn der Interessent für Ihr Geschäft relevant ist und das Prospecting angemessen ist

Vertragserfüllung: nur bei vorheriger Beziehung

Auch der ePrivacy-Rahmen spielt eine Rolle. Die Kombination aus DSGVO + ePrivacy + LSSI macht Cold B2B-E-Mail in Spanien zu einem komplexen Terrain.

Auswirkung auf A/B-Tests

Problem: Wenn Ihre Rechtsgrundlage schwach ist oder Ihr Abmeldeprozess unklar ist, erhalten Sie möglicherweise in bestimmten Tests mehr Spam-Beschwerden, nicht wegen des Textes, sondern wegen der wahrgenommenen Eingriffsintensität.

Lösung:

Immer einen klaren Abmelde-Mechanismus einbauen (idealerweise One-Click)

Transparenz darüber schaffen, wer Sie sind und warum Sie Kontakt aufnehmen

Aktualisierte Sperrlisten pflegen und Abmeldungen sofort respektieren

Berücksichtigen, dass einige Tests die rechtliche Reibung erhöhen können, wenn Ton oder Frequenz aggressiver sind

Briefing-Vorlage für jeden A/B-Test

Dokumentieren Sie vor dem Start eines Tests:

1. Hypothese: „Wenn wir X ändern, steigt Y, weil Z“

2. Variable: nur eine (Angebot, erste Zeile, CTA, Länge, Betreff)

3. KPI: positive Antwort / geplantes Meeting

4. MDE (minimal nachweisbarer Effekt): minimale Verbesserung, die den Aufwand wert ist (Beispiel: +1 Antwortpunkt)

5. Mindeststichprobe pro Variante: mit statistischem Tool berechnet

6. Segmente: ICP und Strata (gmail/outlook/corporate, Land, Branche, Rolle)

7. Leitplanken: Bounce <2 %, Spam-Beschwerden <0,1 %, Abmeldungen <0,5 %

8. Stoppkriterien: fixes Datum oder Mindest-n erreicht

9. Entscheidung: A gewinnt / B gewinnt / nicht schlüssig (keine Signifikanz)

10. Dokumentiertes Lernen: Was Sie wiederverwenden und in welchen zukünftigen Kampagnen

Dieses Briefing zwingt Sie dazu, vor der Ausführung nachzudenken, und vermeidet improvisierte Tests, die Volumen verschwenden.

3 reale Szenarien, in denen A/B-Tests Ergebnisse liefern

SaaS-Startup skaliert Outbound mit kleinem Team

Ein Startup mit 2 SDRs muss jeden Kontakt maximieren. Es kann sich nicht leisten, Leads mit generischen Nachrichten zu verschwenden.

Einsatz von A/B-Tests:

Sie testen das Angebot (ROI vs. Zeitersparnis) mit 1.500 Leads pro Variante

Sie stellen fest, dass „Zeitersparnis“ +2,3 Punkte positive Antworten bringt

Sie übertragen das Gelernte auf alle zukünftigen Sequenzen

In 3 Monaten verdoppeln sie die Meetings, ohne das Volumen zu erhöhen

Wichtig: Bei geringem Volumen priorisieren sie hochwirksame Tests (Angebot, Ansatz) vor Details (Betreff, Signatur).

Industrieunternehmen führt neues Produkt ein

Ein industrielles B2B-Unternehmen möchte Nachrichten für ein neues Produkt validieren, bevor mehr SDRs eingestellt werden.

Einsatz von A/B-Tests:

Sie testen 3 verschiedene Ansätze: Kostensenkung, regulatorische Konformität, operative Effizienz

Sie segmentieren nach Branche: Fertigung, Logistik, Bau

Sie stellen fest, dass regulatorische Konformität im Bau besser funktioniert, aber Kostensenkung in der Fertigung gewinnt

Ergebnis: Sie personalisieren Nachrichten nach Branche und verbessern die Meeting-Rate um +40 % gegenüber der generischen Nachricht.

Wichtig: ICP-Segmentierung und konkrete Erkenntnisse nach Branche.

Growth-Agentur testet Multichannel-Sequenzen

Eine Agentur betreut Outbound für mehrere Kunden und möchte komplette Sequenzen optimieren.

Einsatz von A/B-Tests:

Sequenz A: E-Mail (Tag 0) → LinkedIn (Tag 2) → E-Mail (Tag 5) → Anruf (Tag 8)

Sequenz B: E-Mail (Tag 0) → E-Mail (Tag 3) → LinkedIn (Tag 5) → E-Mail (Tag 7)

Sie messen die Attribution mit Last-Touch und Time-Decay

Ergebnis: Sequenz A erzeugt mehr frühe Antworten, aber Sequenz B hat die bessere finale Meeting-Rate (+15 %).

Wichtig: Testen Sie komplette Abläufe, nicht isolierte Nachrichten.

Warum Enginy AI A/B-Tests in Cold-E-Mails erleichtert, ohne die Zustellbarkeit zu opfern

Strenge A/B-Tests in Cold-E-Mails erfordern Infrastruktur, saubere Daten und konsistente Ausführung. Genau hier bleiben viele Unternehmen hängen: Sie wollen testen, haben aber das nötige Setup nicht.

Angereicherte Daten und präzise Segmentierung

Enginy aggregiert Daten aus über 30 Quellen und nutzt Waterfall-Enrichment mit mehreren Anbietern, weit über typische Lead-Mining-Software hinaus. Das liefert Ihnen:

Vollständige Abdeckung: gültige E-Mails, aktualisierte Rollen, Intent-Signale

Präzise Segmentierung: Sie können Tests nach Branche, Größe, Rolle, Geografie stratifizieren

Datenhygiene: reduziert Bounces und verbessert die Zustellbarkeit von Anfang an

Wenn Ihre Daten sauber und vollständig sind, sind Ihre Tests verlässlicher, weil Sie Rauschen durch ungültige E-Mails oder falsche Rollen eliminieren.

Multichannel-Ausführung mit Konsistenz

Traditionell erfolgt Vertriebs-Prospecting über isolierte Kanäle (E-Mail, LinkedIn, Telefon …). Mit Enginy, einem modernen B2B-Prospektionstool, können Sie das gesamte Prospecting in einen einzigen automatisierten Ablauf integrieren, mit zentralisierten Daten für bessere Entscheidungen.

Das erleichtert A/B-Tests von kompletten Sequenzen:

E-Mail + LinkedIn + Follow-up in einem einzigen Ablauf

Klare Attribution, welcher Touchpoint die Antwort ausgelöst hat

Konsistenz bei Timing und Reihenfolge zwischen Varianten

Wenn alle Kanäle verbunden sind, können Sie komplette Strategien statt isolierter Nachrichten testen.

Kontrollierte Zustellbarkeitsinfrastruktur

Enginy ermöglicht es Ihnen, während der Tests technische Leitplanken beizubehalten:

Gleiche Authentifizierung (SPF, DKIM, DMARC) in allen Varianten

Überwachung von Bounces, Spam-Beschwerden und Platzierung

Kontrolliertes Warmup und konsistentes Volumen

So stellen Sie sicher, dass Ihre „Gewinner“ wirklich im Text besser sind und nicht nur aufgrund einer anderen technischen Konfiguration besser zugestellt werden.

CRM-Integration zur Messung echter Konversion

Über eine robuste CRM-Integration lässt sich Enginy problemlos in bestehende CRMs (HubSpot, Salesforce, Pipedrive) integrieren, ohne sie ersetzen zu müssen. Dadurch können Sie:

End-to-End-Konversion messen: von der E-Mail bis zum Meeting und zur Opportunity

Den echten ROI jeder Variante berechnen

Die Schleife zwischen Outreach und Pipeline schließen

Ohne CRM-Integration können Sie nur Antworten messen. Mit Integration messen Sie den Geschäftseffekt.

Produktivität: Mehr Tests ohne mehr Ressourcen

Enginy AI macht Vertriebsteams deutlich produktiver, automatisiert repetitive Aufgaben und spart Stunden an Arbeit, und ergänzt Ihre bestehenden KI-Vertriebstools.

Anstatt jeden Test manuell zu konfigurieren, Listen zu segmentieren, Sequenzen zu starten und Ergebnisse in Tabellen zusammenzuführen, können Sie:

Tests in wenigen Minuten konfigurieren

Varianten mit automatischer Konsistenz ausführen

Segmentierte Ergebnisberichte nach ICP erhalten

Das bedeutet, dass Sie mehr Tests mit weniger Aufwand durchführen und schneller lernen können.

Häufig gestellte Fragen (FAQs)

Was ist A/B-Testing in Cold-E-Mails?

A/B-Testing in Cold-E-Mails ist eine experimentelle Methode, bei der Sie zwei Versionen einer Nachricht (A und B) an zufällige Gruppen von Interessenten senden, um zu bestimmen, welche bessere Ergebnisse erzielt. Anders als im E-Mail-Marketing optimieren Sie bei Cold-E-Mails auf positive Antworten und Meetings, nicht auf Klicks.

Wie viele Kontakte brauche ich für einen gültigen A/B-Test?

Das hängt von Ihrer Baseline (aktueller Konversionsrate) und der minimalen Verbesserung ab, die Sie erkennen wollen. Als Orientierung:

Von 4 % auf 5,5 % positive Antworten: ca. 3.100 Kontakte pro Variante

Von 4 % auf 5 %: ca. 6.700 pro Variante

Von 1 % auf 1,5 %: ca. 7.700 pro Variante

Ohne ausreichendes Volumen ist es besser, Erkenntnisse über mehrere Wochen zu sammeln oder größere Änderungen zu testen.

Was sollte ich in Cold-E-Mails zuerst testen?

Priorisieren Sie Variablen mit dem größten Einfluss auf die Antwort:

Angebot und Ansatz: Hauptschmerzpunkt, Versprechen, Reibungsgrad

Erste Zeile (erste 150 Zeichen): Personalisierung vs. Vorlage

CTA: 1 Schritt vs. 2 Schritte, geschlossen vs. offen

Länge und Struktur: kurz vs. zusätzlicher Kontext

Heben Sie Betreff und Signatur für später auf. Das Angebot ist 10-mal wichtiger als die Betreffzeile.

Warum ist die Öffnungsrate keine gute Metrik?

Apple Mail Privacy Protection lädt Inhalte vor und kann Öffnungen künstlich aufblähen. Außerdem sagen Öffnungen nichts über positive Antworten aus: Jemand kann aus Neugier öffnen und nie antworten.

Bessere Metriken:

Rate positiver Antworten (echtes Interesse, Meeting akzeptiert)

Rate gebuchter Meetings

Konversionsrate zu Opportunities im CRM

Optimieren Sie auf nützliche Gespräche, nicht auf Neugier.

Wie vermeide ich, meine Domain während der Tests zu verbrennen?

Leitplanken für die Zustellbarkeit:

Spam-Beschwerden unter <0,1 % halten (Gmail empfiehlt <0,10 %)

Bounce-Rate unter <2 % halten

Vollständige Authentifizierung umsetzen: SPF, DKIM, DMARC

One-Click-Unsubscribe verwenden (RFC 8058)

Die technische Infrastruktur zwischen Varianten nicht ändern

Wenn eine Variante Beschwerden oder Bounces erhöht, sofort stoppen, auch wenn die KPI steigt.

Kann ich mehrere Variablen gleichzeitig testen?

Technisch ja (faktorielles Design), aber für die meisten Teams nicht empfehlenswert. Das Testen mehrerer Variablen erfordert:

Viel mehr Stichprobe (4x für ein 2x2-Faktoriell)

Komplexere statistische Analyse

Risiko von Interaktionen, die die Ergebnisse verwirren

Besserer Ansatz: 1 Hypothese, 1 Variable, 1 Test. Lernen, anwenden, wiederholen.

Wie messe ich, ob eine Antwort „positiv“ ist?

Klassifizieren Sie zunächst manuell eine Stichprobe und automatisieren Sie dann:

Positiv: „Ich bin interessiert“, „Lassen Sie uns sprechen“, „Erzählen Sie mir mehr“, verweist auf den Entscheidungsträger, akzeptiert ein Meeting

Neutral: „nicht jetzt“, „versuchen Sie es in Q2“, „schicken Sie mir Infos“

Negativ: „nicht interessiert“, „passt nicht“, „abmelden“

Rauschen: OOO, automatische Antworten, Bounces

Optimieren Sie nur auf positive Antworten. Eine Antwortrate von 15 % hilft nicht, wenn 12 % „nein danke“ sind.

Wie lange sollte ein A/B-Test laufen?

Hängt von Ihrem Versandvolumen und Ihrem Antwortzyklus ab:

Mindestdauer: Zeit, um die berechnete Mindeststichprobe zu erreichen

Empfohlen: 2–3 Wochen, um späte Antworten und Follow-up-Effekte zu erfassen

Maximal: 1 Monat (danach können externe Faktoren verfälschen)

Regel: Definieren Sie vor dem Start Stoppkriterien und halten Sie sich daran, auch wenn es früher so aussieht, als würde es gewinnen.

Wie funktioniert A/B-Testing, wenn ich Multichannel-Outreach mache?

Beim Multichannel-Prospecting (E-Mail + LinkedIn + Anrufe) wird A/B-Testing komplizierter, weil die Konversion aus der Kombination von Touchpoints entstehen kann.

Beste Vorgehensweise:

Komplette Sequenzen testen, nicht isolierte Nachrichten

Last-Touch- oder Time-Decay-Attribution verwenden, um den Kredit zuzuweisen

Alle Kanäle konstant halten, außer der Variablen, die Sie testen

Wenn Sie E-Mail und LinkedIn gleichzeitig ändern, wissen Sie nicht, was das Ergebnis erzeugt hat.

Kann Enginy mir bei A/B-Tests in Cold-E-Mails helfen?

Ja. Enginy erleichtert strenge A/B-Tests durch:

Angereicherte Daten aus über 30 Quellen für präzise Segmentierung

Konsistente Multichannel-Ausführung (E-Mail + LinkedIn) in einem einzigen Ablauf

Kontrollierte Infrastruktur zur Stabilisierung der Zustellbarkeit

CRM-Integration zur Messung echter Konversion (Meetings, Opportunities)

Automatisierung, mit der Sie mehr Tests ohne mehr Ressourcen durchführen können

So können Sie komplette Strategien rigoros testen, statt nur Betreffzeilen zu ändern.